DeepSeek lançou um modelo de raciocínio multimodal e relatório técnico no GitHub, intitulado "Pensando com Primitivos Visuais (Pensando com Primitivos Visuais)". Este modelo é construído com base no DeepSeek V4-Flash (284B de parâmetros totais, 13B de arquitetura MoE ativada durante a inferência) e propõe um novo paradigma de raciocínio multimodal.

O artigo aponta que há um gargalo fundamental nos grandes modelos multimodais existentes que foi ignorado: a "lacuna de referência" (Reference Gap), ou seja, o modelo pode "ver" o conteúdo da imagem, mas ao usar natural linguagem para construir uma cadeia de pensamento durante o processo de raciocínio, descrições vagas, como o grande objeto vermelho à esquerda, perto do centro, não conseguem localizar com precisão o objeto visual em uma cena densa, fazendo com que a atenção se desvie e tire conclusões erradas.

Anteriormente, a direção principal da resposta na comunidade acadêmica era melhorar a resolução perceptual, mas o artigo acredita que ver e ser capaz de dizer claramente o que está sendo dito são duas coisas diferentes.

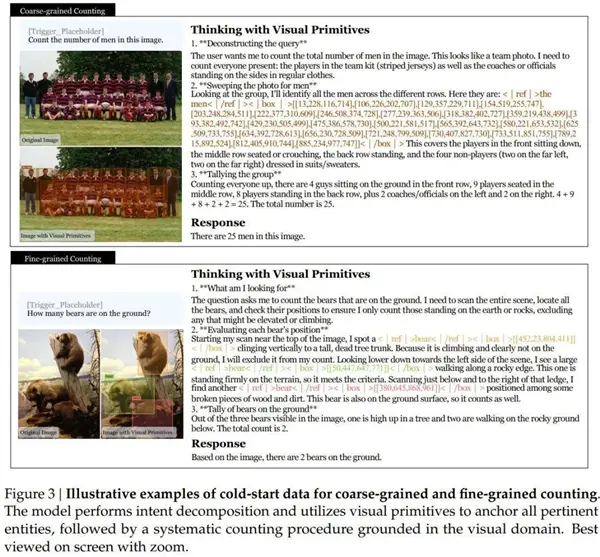

A principal inovação deste modelo é incorporar coordenadas de pontos e caixas delimitadoras no próprio processo de raciocínio, tornando-as a unidade básica da cadeia de pensamento. Cada vez que o modelo menciona um objeto visual durante a inferência, suas coordenadas são geradas de forma síncrona.

Por exemplo, "Encontre um urso [452, 23, 804, 411], suba em uma árvore, exclua-o, olhe para baixo à esquerda e encontre outro [50, 447, 647, 771], parado na beira da rocha, atendendo às condições." As coordenadas não são mais respostas marcadas após o fato, mas âncoras espaciais para eliminar ambiguidades durante o processo de raciocínio.

No nível arquitetônico, o modelo atinge 7.056 vezes a compressão visual, uma imagem de 756 × 756. Após o processamento ViT, foram gerados 2.916 tokens de bloco de imagem, que foram mesclados em 324 tokens através de compressão espacial 3×3. O cache KV foi compactado 4 vezes por meio do mecanismo Compressed Sparse Attention (CSA) e, finalmente, apenas 81 entradas visuais de KV permaneceram.

Como referência, a imagem do mesmo tamanho Claude Sonnet 4.6 requer cerca de 870 peças e Gemini-3-Flash requer cerca de 1100 peças.

Em termos de dados de treinamento, a equipe selecionou aproximadamente 31.700 fontes de dados de alta qualidade de quase 100.000 conjuntos de dados de detecção de alvos e gerou mais de 40 milhões de amostras de treinamento, cobrindo quatro tipos de tarefas: contagem, raciocínio espacial, navegação em labirinto e rastreamento de caminho.

O pós-treinamento adota primeiro a especialização e depois a estratégia de unificação. Dois modelos especialistas, caixa delimitadora e coordenadas de ponto, são treinados separadamente. Após a otimização do aprendizado por reforço, eles são mesclados em um modelo unificado por meio da destilação de políticas online.

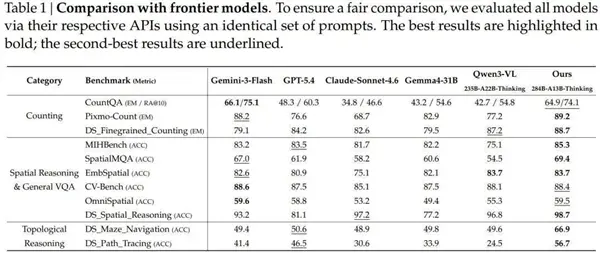

Os resultados experimentais foram comparados com modelos convencionais como Gemini-3-Flash, GPT-5.4 e Claude Sonnet 4.6 em 11 testes de benchmark.

Na tarefa de contagem, a pontuação de correspondência exata do Pixmo-Count é de 89,2%, excedendo a do Gemini-3-Flash 88,2%, e significativamente à frente dos 76,6% do GPT-5.4 e dos 68,7% de Claude do Sonnet 4.6.

A lacuna mais representativa aparece no raciocínio topológico: a pontuação de navegação do labirinto é de 66,9%, GPT-5.4 é de 50,6%, Gemini-3-Flash é de 49,4%, Claude Sonnet 4,6 é de 48,9%, um aumento de cerca de 17 pontos percentuais; a pontuação de rastreamento de caminho é de 56,7%, GPT-5.4 é de 46,5%.

No entanto, o artigo também aponta as limitações atuais: o modelo precisa acionar explicitamente palavras para ativar o mecanismo visual primitivo, a precisão das coordenadas em cenas extremamente refinadas é limitada e ainda há espaço para melhorias nas capacidades de generalização entre cenas.