O Google divulgou pela primeira vez que sua equipe de segurança descobriu e bloqueou com sucesso uma exploração de dia zero que se suspeita ter sido desenvolvida por inteligência artificial durante um ataque cibernético em andamento. De acordo com um relatório divulgado pelo Google Threat Intelligence Group (GTIG), o ataque foi orquestrado por um “conhecido ator de ameaça cibercriminosa” em uma tentativa de lançar um “evento de exploração em grande escala” e atingir uma “ferramenta de gerenciamento de sistema baseada na web de código aberto” sem nome e usá-la para contornar o mecanismo de autenticação de dois fatores (2FA) da plataforma.

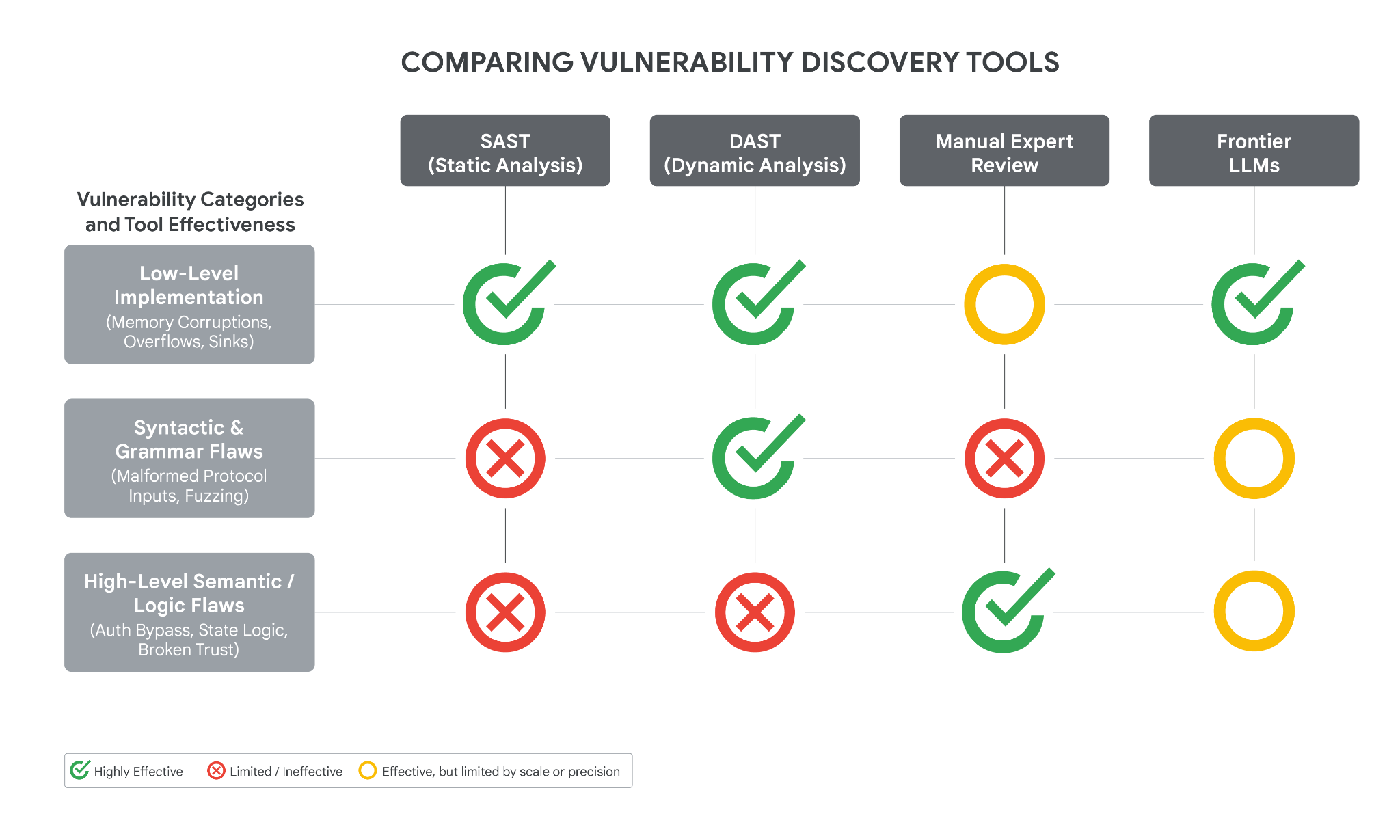

Os pesquisadores do Google encontraram várias pistas no script de exploração Python usado para realizar o ataque que eram suspeitos de serem gerados pela IA, incluindo uma “pontuação CVSS ilusória” e um estilo geral de layout estruturado semelhante a um livro didático. Esses recursos são altamente semelhantes aos formatos comuns de dados de treinamento de grandes modelos de linguagem. O relatório afirma que a vulnerabilidade é essencialmente uma “falha lógica semântica de alto nível” causada pela “codificação de uma suposição de confiança” no design 2FA da plataforma, fornecendo aos invasores um ponto de entrada que pode ser amplificado por ferramentas automatizadas.

O incidente ocorreu num momento em que a indústria está debatendo ferozmente as capacidades dos modelos de IA focados em cenários de segurança cibernética, como o modelo Mythos lançado pela Anthropic, e uma recente descoberta assistida por IA de uma vulnerabilidade do kernel Linux, todos os quais desencadearam atenção contínua ao papel da IA tanto no ataque como na defesa. O Google disse que esta é a primeira vez que encontra evidências claras de que a IA está diretamente envolvida no processo de exploração de vulnerabilidades em um ataque real, mas a equipe de pesquisa também apontou que atualmente “não acredita que o modelo Gemini do próprio Google tenha sido usado neste ataque”.

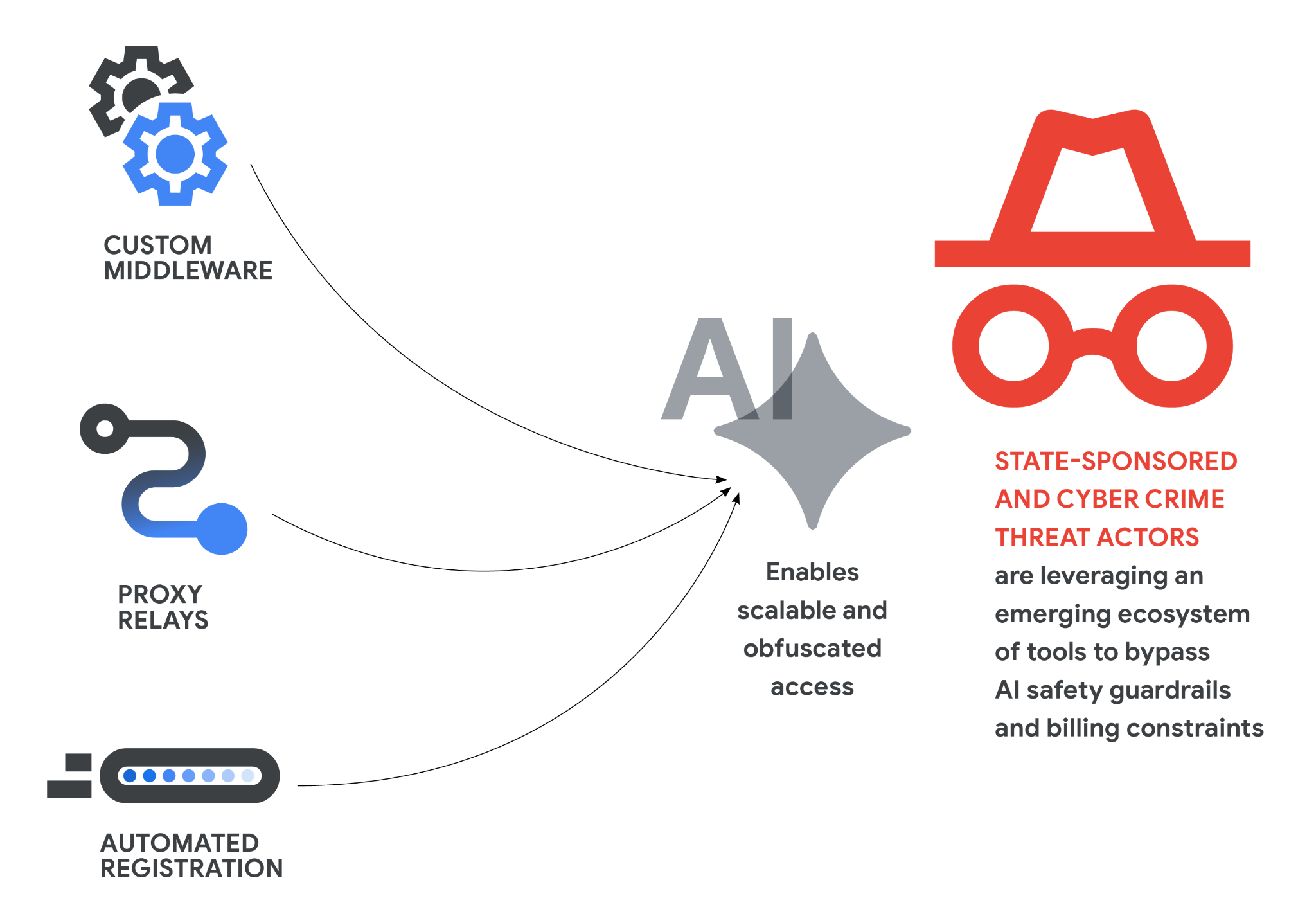

O Google disse que "interrompeu e bloqueou" com sucesso esse ataque específico, mas também alertou que os hackers estão usando cada vez mais sistematicamente a IA para descobrir e explorar vulnerabilidades de segurança, e a automação está acelerando desde a coleta precoce de inteligência até a mineração de vulnerabilidades e a escrita de código de exploração. O relatório lembra ainda que o próprio sistema de IA e o seu ecossistema também estão a tornar-se uma nova superfície de ataque: os atacantes estão a começar a visar componentes mais integrados que fornecem capacidades para a IA, tais como interfaces de ferramentas externas e conectores de dados de terceiros que executam tarefas de forma autónoma, a fim de encontrar novos caminhos de intrusão.

Além de usar IA para escrever código de ataque, o Google também nomeou um tipo de técnica de disseminação no relatório – “jailbreak orientado à personalidade”. O invasor construirá cuidadosamente palavras de alerta para deixar o modelo “atuar” como um pesquisador sênior de segurança ou especialista em testes de penetração, induzindo-o a produzir conteúdo que deveria ser interceptado por políticas de segurança, inclusive ajudando a localizar possíveis vulnerabilidades de segurança no sistema ou gerando ideias de exploração. O Google enfatizou que esse tipo de padrão de ataque mostra que o papel da IA no campo da segurança de rede está evoluindo rapidamente de uma simples ferramenta defensiva para um novo “multiplicador” tanto para o ataque quanto para a defesa. No futuro, esses ataques de dia zero com envolvimento profundo da IA poderão não ser mais uma exceção.