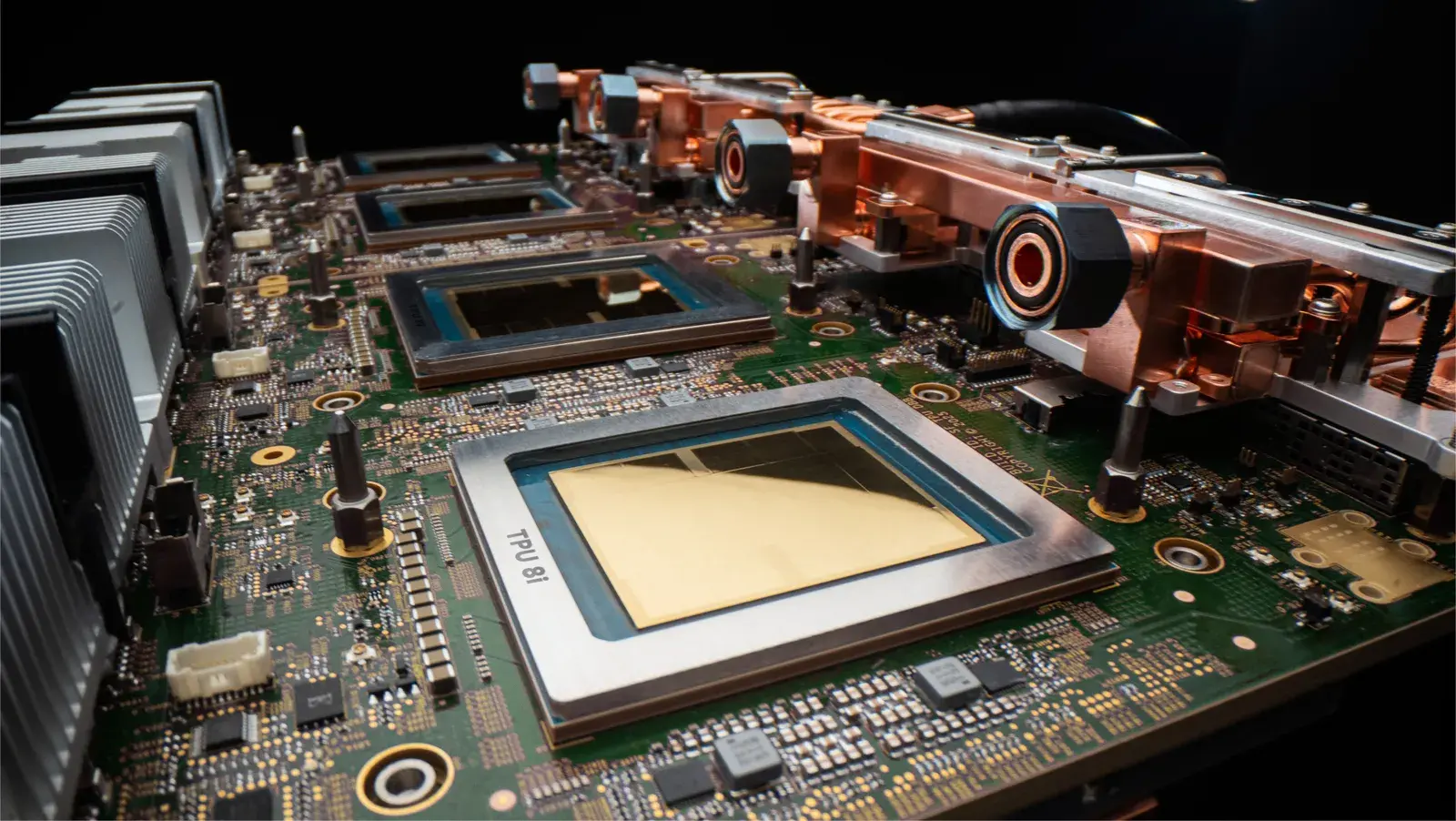

De acordo com notícias de 23 de abril, quarta-feira, horário dos EUA, o Google anunciou oficialmente que sua unidade de processamento tensor (TPU) de oitava geração deu início a um grande ajuste estratégico: pela primeira vez, separará as tarefas de "treinamento" e "inferência" do modelo de IA e as entregará a dois chips proprietários independentes. Espera-se que esses dois processadores de próxima geração cheguem ao mercado ainda este ano.

A mudança marca uma nova rodada de competição entre Google e Nvidia na área de hardware de IA.

"Por que avançar para a especialização do poder computacional?" Amin Vahdat, vice-presidente sênior e diretor de tecnologia de IA e infraestrutura do Google, disse em um blog oficial. “Com a ascensão dos agentes de IA, acreditamos que o fornecimento de chips especialmente otimizados para necessidades de treinamento e raciocínio beneficiará todo o ecossistema tecnológico”.

Atualmente, a velocidade de inferência da IA está se tornando o principal campo de batalha para os grandes fabricantes. Em março, a Nvidia anunciou um novo chip que permitiria aos modelos responder rapidamente às perguntas dos usuários, em grande parte graças à tecnologia adquirida na aquisição da startup de chips Groq, por US$ 20 bilhões. Neste contexto, embora o Google ainda seja o principal cliente da NVIDIA, está construindo soluções alternativas de poder computacional, fornecendo TPUs para empresas de serviços em nuvem.

Na verdade, tornou-se um consenso da indústria que os gigantes da tecnologia construíssem pessoalmente núcleos e buscassem poder de computação independente. Através da personalização profunda da arquitetura subjacente, as empresas podem maximizar a eficiência operacional de cenários de aplicativos específicos. Do Neural Engine que a Apple integrou aos iPhones ao longo dos anos, ao chip de IA de segunda geração da Microsoft iterado em janeiro deste ano, à recente revelação da Meta de que está trabalhando com a Broadcom para desenvolver uma variedade de processadores de IA, todos confirmam essa tendência.

Neste “movimento de criação de núcleos”, o Google pode ser considerado um pioneiro. A empresa começou a implantar processadores de IA autodesenvolvidos em 2015 e fornece serviços de poder de computação a clientes externos por meio de uma plataforma em nuvem desde 2018. Para efeito de comparação, a Amazon AWS lançou chips Inferentia dedicados à inferência e processadores Trainium dedicados ao treinamento em 2018 e 2020, respectivamente.

Analistas do banco de investimento D.A. Davidson estimou em um relatório de setembro passado que a avaliação combinada dos negócios de TPU do Google e da divisão DeepMind AI era de aproximadamente US$ 900 bilhões.

Atualmente, a Nvidia ainda ocupa o domínio absoluto no mercado de poder de computação de IA. O Google não comparou diretamente produtos similares da Nvidia neste lançamento, mas divulgou seus próprios dados de iteração de desempenho: com o mesmo custo, o desempenho do novo chip de treinamento é 2,8 vezes maior que o TPU de sétima geração (codinome Ironwood) lançado em novembro do ano passado, e o desempenho do novo chip de inferência aumentou 80%.

Vale ressaltar que no roteiro técnico, a indústria aposta unanimemente na memória estática de acesso aleatório (SRAM). Seja o próximo LPU Groq 3 da Nvidia ou o unicórnio de chip AI Cerebras, que acaba de enviar seu pedido de IPO este mês, todos eles dependem fortemente dessa tecnologia. O novo chip de inferência TPU 8i lançado desta vez pelo Google também segue essa tendência. Sua capacidade SRAM de um único chip chega a 384 MB, o que é três vezes maior que a geração anterior do Ironwood.

O CEO da Alphabet, Sundar Pichai, apontou em uma postagem no blog que o objetivo do design da nova arquitetura é "fornecer grande rendimento (Throughput) e baixa latência (Latência), apoiando assim milhões de agentes de IA para execução simultânea com custo-benefício extremamente alto".

Em termos de aplicações de terminais, o Google revelou que a comercialização dos seus chips de IA está em expansão. Entre eles, o formador de mercado Citadel Securities desenvolveu software de pesquisa quantitativa baseado em TPU; 17 laboratórios nacionais do Departamento de Energia dos EUA estão implantando totalmente sistemas "AI Co-cientista" baseados neste chip. Além disso, a startup de IA Anthropic se comprometeu a usar os recursos de poder de computação TPU do Google de vários gigawatts.