Os preços das memórias aumentaram de 3 a 5 vezes este ano, o que afetou seriamente a disposição de todos de consumir PCs e telefones celulares. O culpado deste enorme aumento nos preços da memória é a forte procura por IA. Todo mundo sabe que a IA tem requisitos muito altos de capacidade e largura de banda de memória (incluindo memória de vídeo em GPUs), mas quão alto pode ser? A TPU de oitava geração lançada pelo Google há poucos dias é o melhor exemplo.

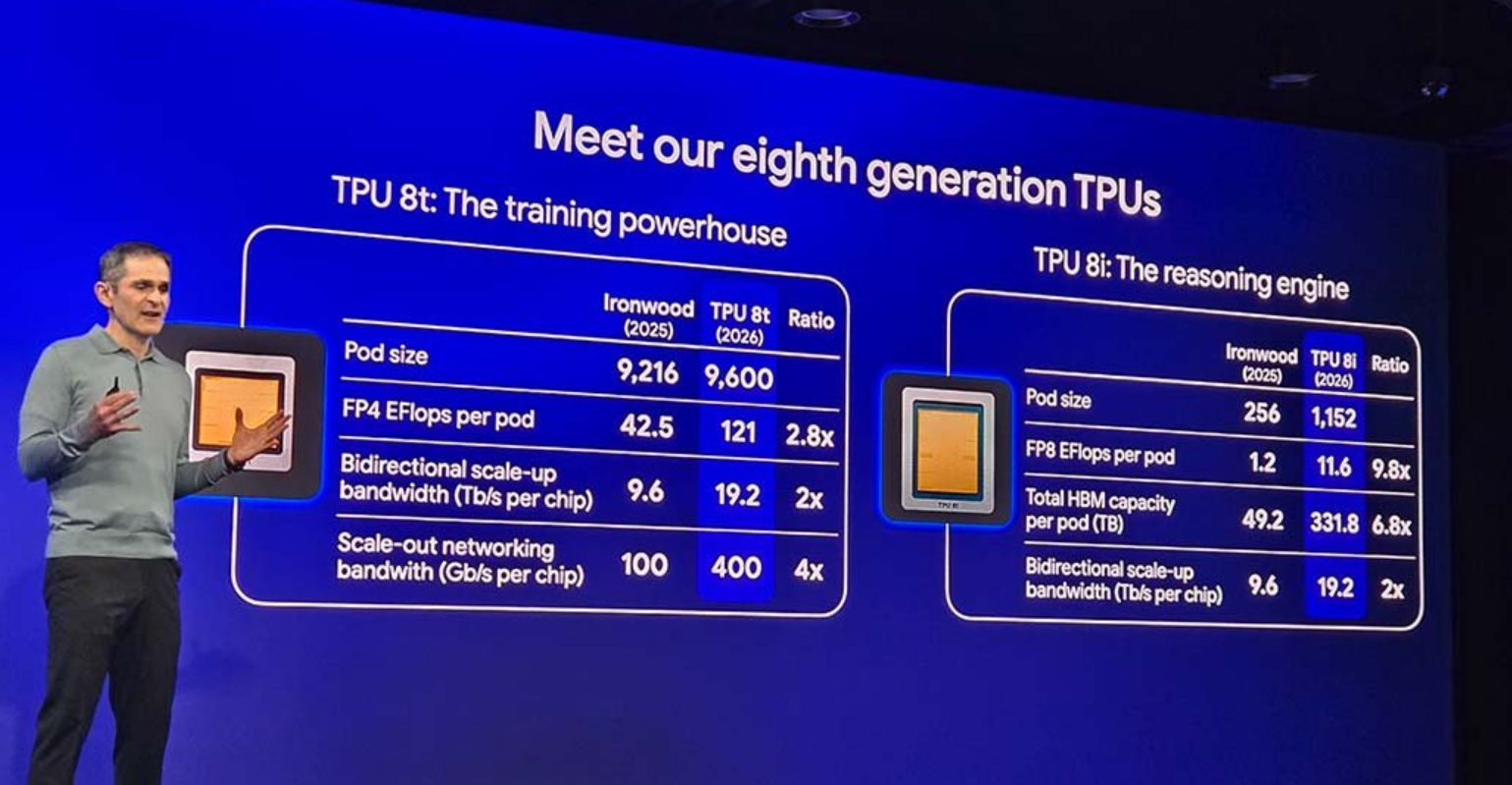

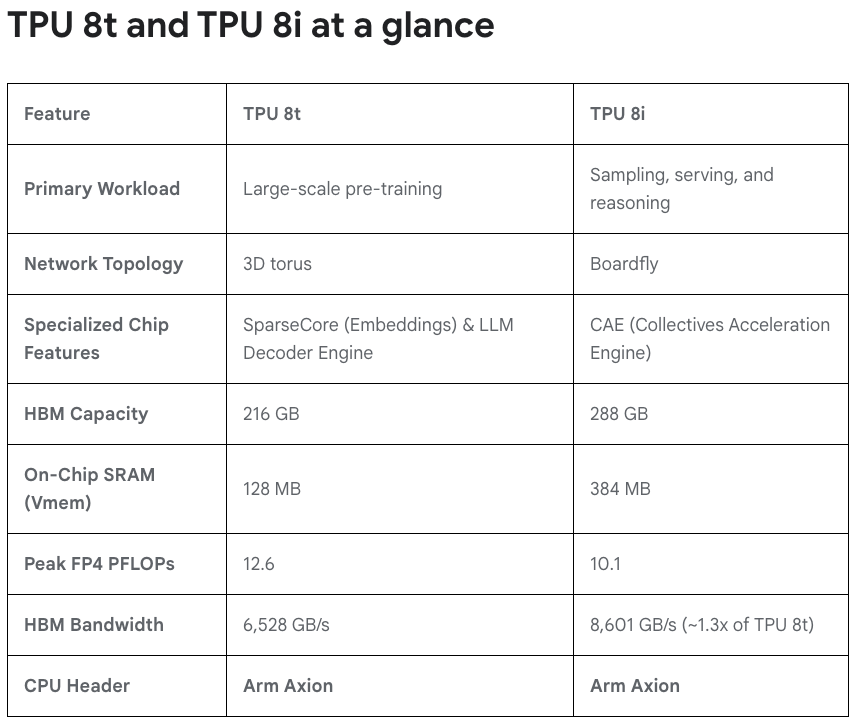

A TPU v8 deste ano diferencia entre treinamento e raciocínio pela primeira vez. V8T se concentra no treinamento de IA. Embora o Google diga que também pode raciocinar, ele é usado principalmente para treinamento.Cada nó Pod é empilhado com 9.600 chips V8T e o desempenho do FP4 atinge 121EFlops., a largura de banda da memória é de 19,2 TB/s e a largura de banda do chip interno é de 400 GB/s, o que é uma mudança de quase 2 a 4 vezes.

O V8i é voltado principalmente para cargas de inferência de IA e as especificações precisam ser bastante reduzidas. Cada nó possui apenas 1152 chips V8i, o poder de computação é reduzido para 11,6EFlops e a largura de banda da memória permanece inalterada em 19,2 TB/s.

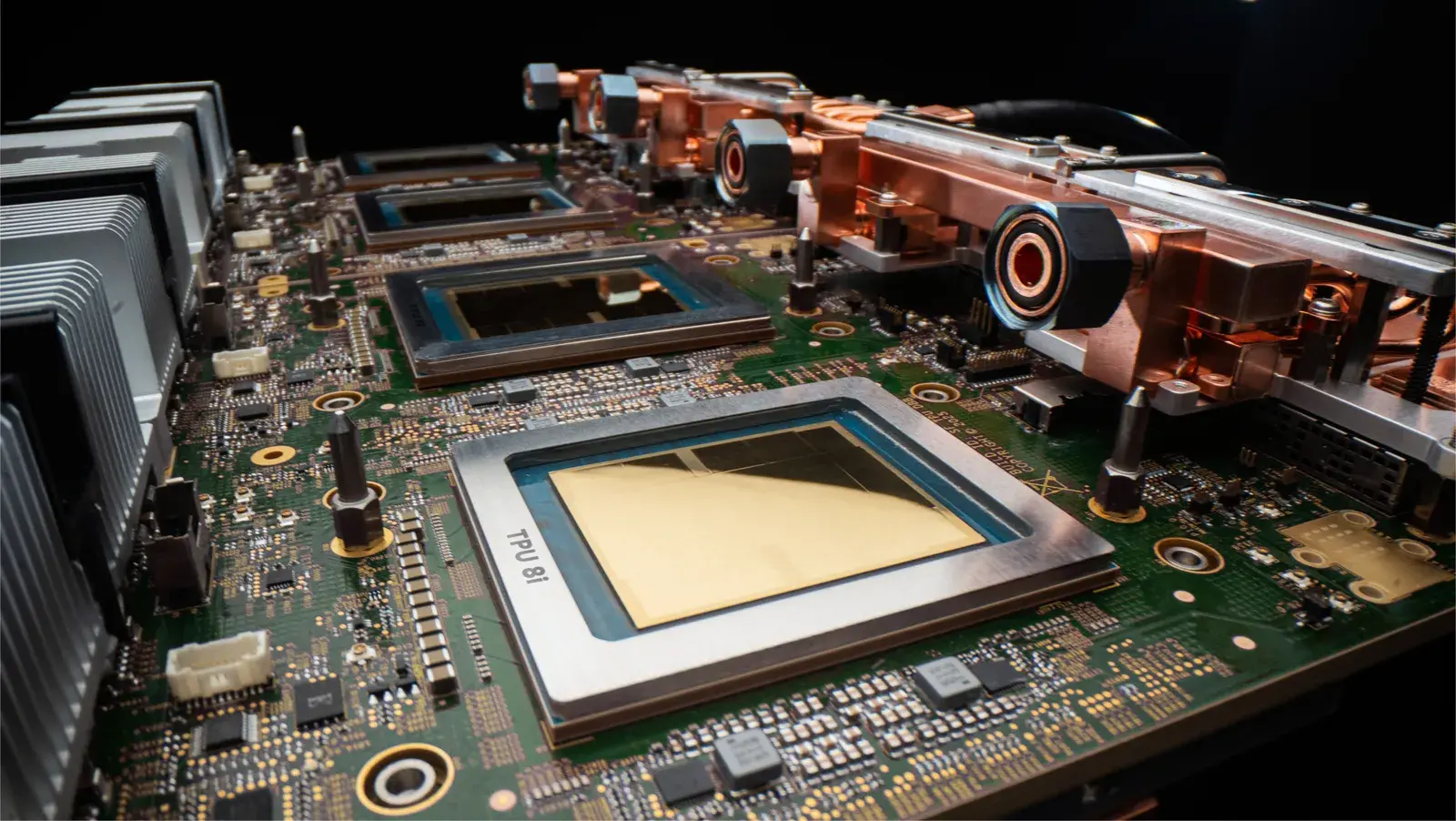

Vale a pena notar que a capacidade da memória aumentou significativamente desta vez.O V8i também atinge 331,8 TB de memória HBM, e o V8T tem uma memória HBM exagerada de 2 PB. Cada chip V8T está equipado com 216 GB de memória HBM.

O conceito de design do Google desta vez é quebrar a barreira de memória dos gargalos da IA. O HBM 2PB não é apenas uma capacidade total supergrande, mas também é usado como um endereço global único dentro de um nó. Embora a GPU da NVIDIA já tenha sido capaz de empilhar memória HBM de nível PB por meio de tecnologias como NVLink, a conexão não pode ignorar a rede tradicional do data center, o que causará gargalos de desempenho e latência.

Larry Carvalho, consultor-chefe da RobustCloud, disse que quebrar o “muro da memória” marca uma mudança competitiva potencialmente importante para o Google no campo de chips de IA.

Mas para as pessoas comuns, o lançamento da memória HBM de 2 PB pelo Google não é um bom sinal, porque significa que a demanda por memória da IA ainda está aumentando.Você deve saber que a memória HBM geralmente consome 2 a 4 vezes mais capacidade de produção de chips DRAM do que a memória DDR convencional.Quanto mais HBM for usado, mais capacidade de memória DDR será ocupada.

Mesmo que a demanda aumente, Samsung, SK Hynix, Micron e outras empresas darão prioridade para garantir a demanda da HBM, mas já deixaram claro que não aumentarão significativamente a capacidade de produção de chips. Obviamente, a escassez de chips de memória se tornará mais grave e não se pode esperar que os preços caiam rapidamente.