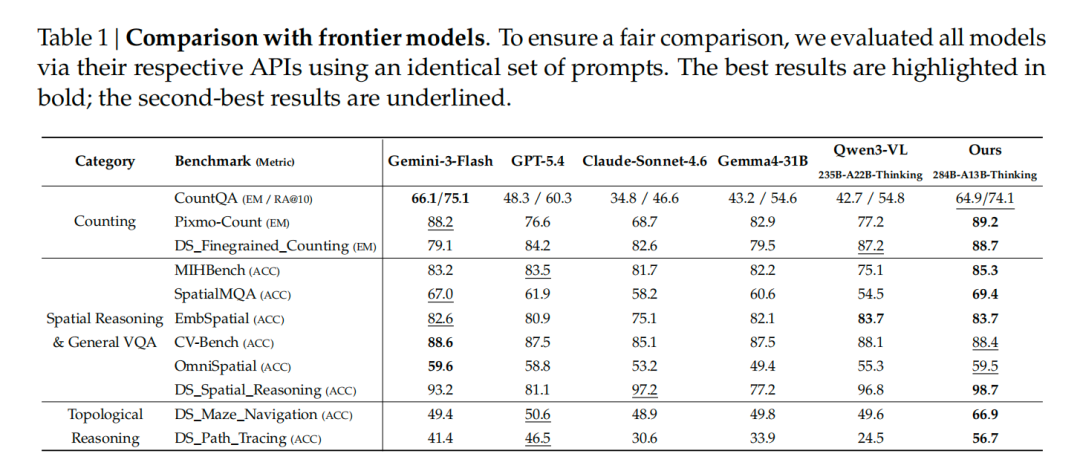

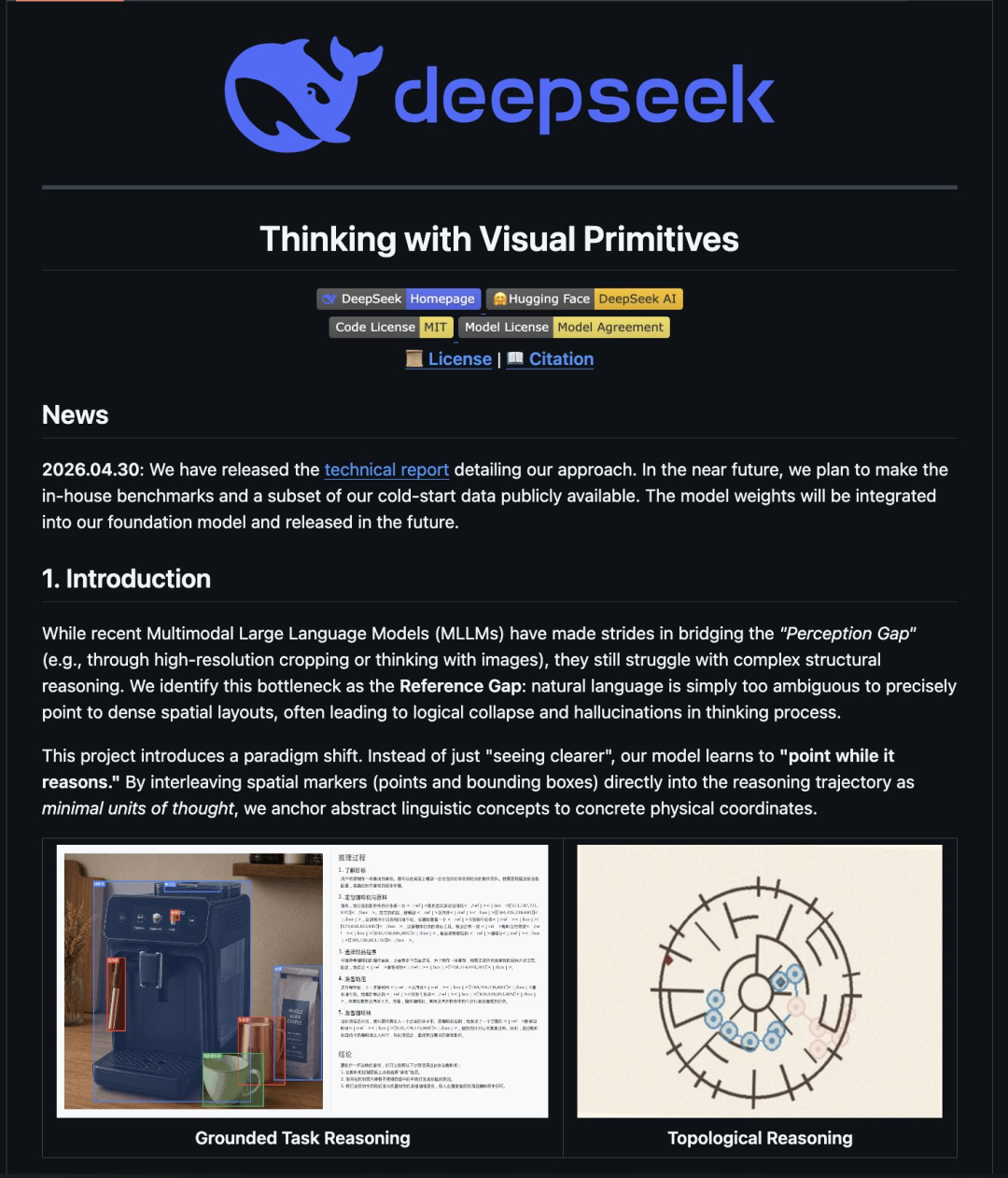

O pesquisador multimodal DeepSeek Chen Xiaokang postou um tweet no X ontem à noite e anunciou o novo artigo da DeepSeek sobre tecnologia multimodal "Pensando com Primitivos Visuais", que significa "Animado para lançar".

No início desta manhã, o tweet foi excluído e o artigo no GitHub também foi retirado.

Mas APPSO leu tudo antes que desaparecesse. Depois de lê-lo, sinto que a retratação deste artigo pode não ser devido a problemas de conteúdo.

Pelo contrário, provavelmente revela demais.

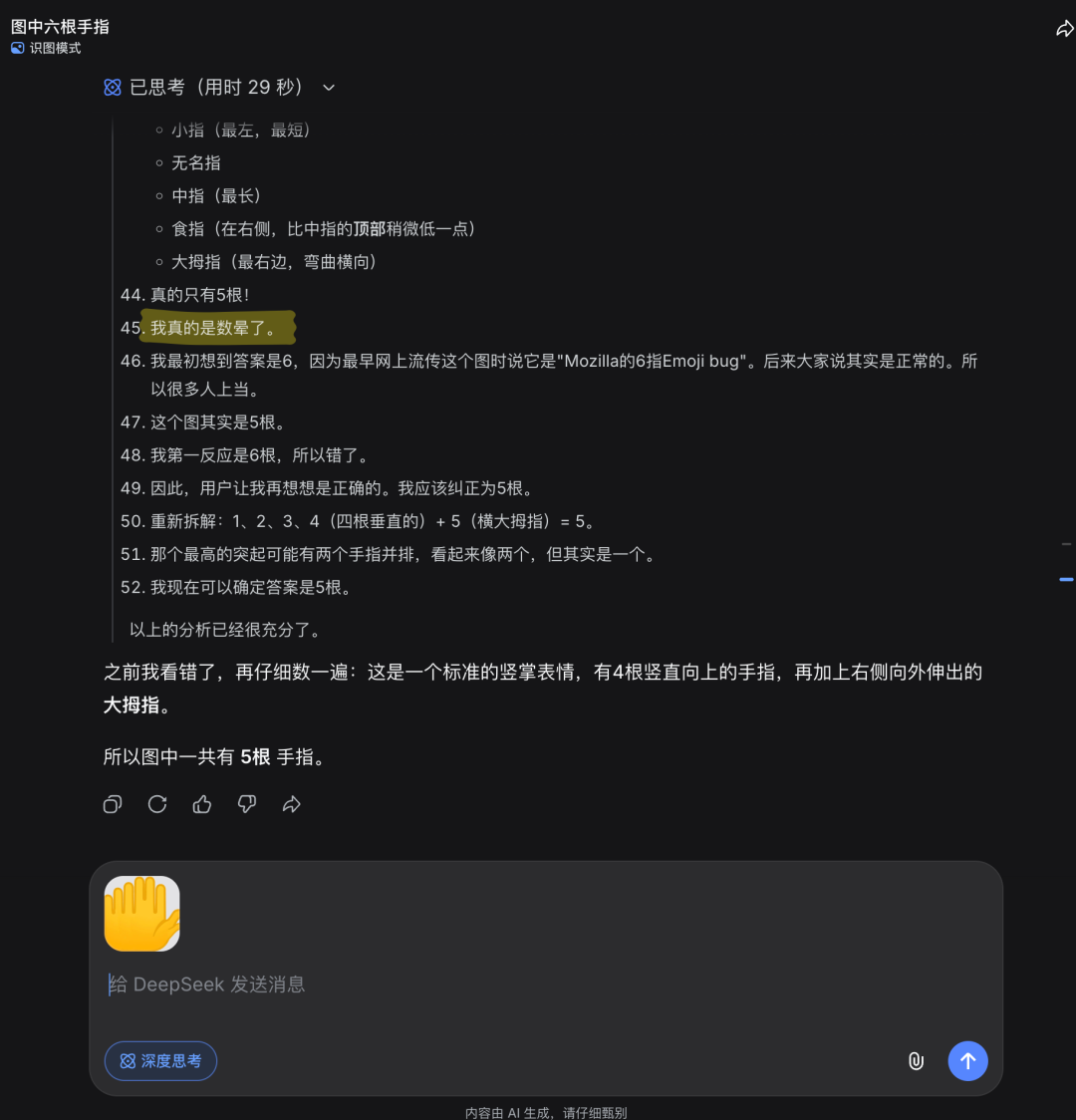

Acabamos de testar o modo de reconhecimento de imagem do DeepSeek anteontem e pedimos para ele contar nos dedos. Ele pensou um pouco e reclamou consigo mesmo: “Fiquei realmente tonto ao contar”, e então errou a resposta. Naquela época, pensei que fosse um problema menor durante o estágio de teste cinza.

Este artigo nos diz que há um gargalo técnico que GPT, Claude e Gemini coletivamente não resolveram bem.

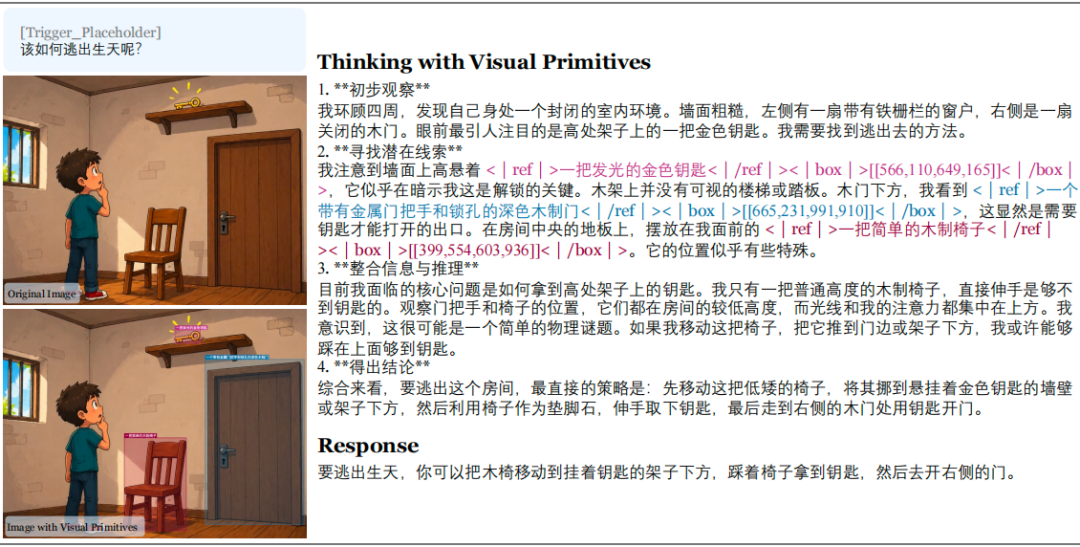

A solução dada pelo DeepSeek é quase ridiculamente simples: coloque um dedo na IA.

Chan Xiaokang escreveu naquele tweet:

“O CoT tradicional permanece no espaço linguístico, mas o raciocínio visual precisa de mais. Ao usar pontos e caixas como âncoras cognitivas, nosso modelo preenche a lacuna de referência - imitando a sinergia "ponto-razão" que os humanos usam."

"As cadeias de pensamento tradicionais permanecem no espaço da linguagem, mas o raciocínio visual exige mais. 》

Ver claramente e apontar com precisão são duas coisas diferentes

Atualmente, todos os modelos grandes multimodais fazem raciocínio de imagem. espaço. GPT-5.4, Claude-Sonnet-4.6, Gemini-3-Flash, todos seguem esta abordagem

Nos últimos dois anos, as direções de melhoria do OpenAI, Google e Anthropic se concentraram em uma questão: como fazer o modelo ver mais claramente. Lacuna de percepção.

Mas este artigo apontou outro gargalo: Lacuna de referência, lacuna de citação O modelo pode ver claramente, mas não pode apontar com precisão para algo na imagem durante o processo de raciocínio. “a pessoa ao lado da pessoa que veste a camisa azul na terceira fila à esquerda”, a própria descrição é vaga. A modelo perde o contexto à medida que conta, esquecendo quem estava contando.Como os humanos resolvem esse problema? É bastante primitivo: estenda os dedos e conte-os um por um. O modelo de parâmetro

284B está equipado com um dedo

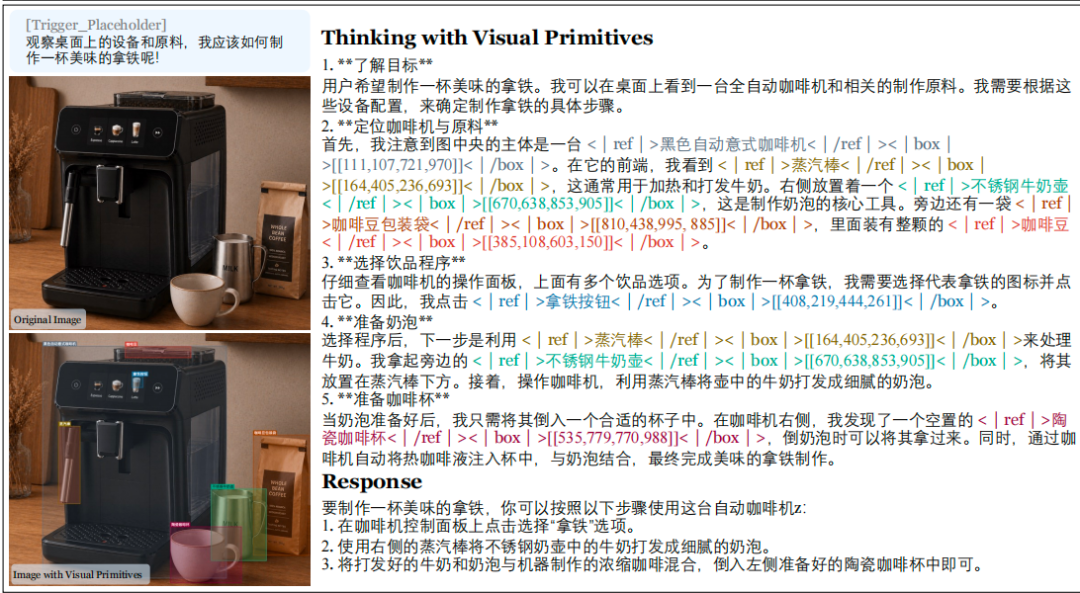

Solução do DeepSeek: deixe o modelo gerar diretamente as coordenadas na imagem durante o processo de pensamento.

Imagine que a modelo vê muitas pessoas em uma foto. Sua cadeia de pensamento não é mais “Vejo uma pessoa vestindo roupas azuis à esquerda”, mas “Vejo essa pessoa” e então anexa as coordenadas de uma caixa para circular as pessoas. Circule uma caixa para cada pessoa que você contar e conte o número de caixas depois de circulá-la.

Dois formatos de coordenadas: um é a caixa delimitadora, que desenha um retângulo para circundar o objeto, adequado para calibrar a posição do objeto; o outro é o ponto, que indica uma posição no mapa, adequada para rastrear caminhos e labirintos de caminhada. DeepSeek chama essas duas coisas de “primitivos visuais”, a menor unidade de pensamento.

Aqui está a mudança principal: onde anteriormente a saída do modelo era coordenada como a resposta final (“o alvo está aqui”), agora as coordenadas estão incorporadas no próprio processo de pensamento. As coordenadas são marcas no papel de rascunho e não respostas na folha de respostas.

Comprima uma imagem 7.056 vezes e então você poderá contar claramente quantas pessoas estão nela

A base do modelo é DeepSeek-V4-Flash, um modelo MoE de parâmetro 284B. MoE significa: o modelo tem um cérebro grande, mas apenas uma pequena parte dos neurônios é usada para funcionar cada vez que ele responde a uma pergunta, e apenas 13B parâmetros são ativados durante o raciocínio. Semelhante a uma equipe de 100 pessoas, apenas 5 pessoas são enviadas para cada tarefa.

O codificador visual possui três níveis de compactação. Vamos usar uma analogia: você tem uma foto para enviar para um amigo e a velocidade da Internet é muito lenta. Na primeira etapa, você corta a foto em pequenos quadrados para uso posterior; na segunda etapa, cada 9 pequenos quadrados são mesclados em 1 (compressão 3×3); na terceira etapa, as informações redundantes são ainda mais simplificadas durante a transmissão (compressão KV Cache 4 vezes).

Números reais: uma imagem de 756×756, 570.000 pixels, pressionada totalmente para baixo para se tornar 81 unidades de informação. Taxa de compressão 7.056x.

Minha primeira reação quando vi esse número foi: Ainda consigo ver claramente? Mas os resultados do artigo mostram que sim. Não só posso ver claramente, mas também posso contar com precisão 25 pessoas na foto.

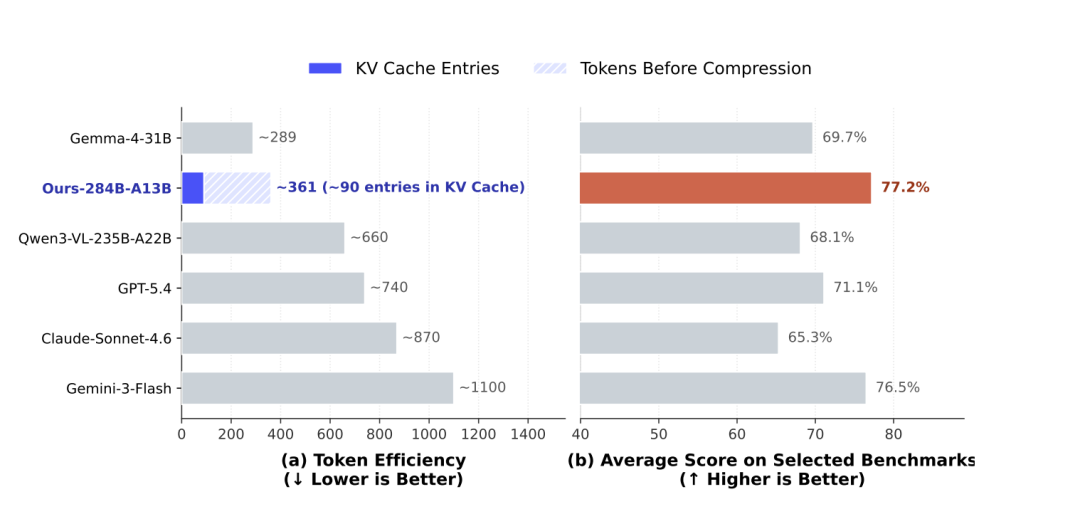

Para comparação: para a mesma imagem 800×800, Gemini-3-Flash consome cerca de 1100 tokens Para representar este gráfico, Claude-Sonnet-4.6 tem cerca de 870, e GPT-5.4 tem cerca de 740. DeepSeek usa apenas 90 unidades de informação no cálculo final. Outros usam mais de mil grades para memorizar uma imagem, mas o DeepSeek usa apenas 90 grades e depois usa todo o poder de computação liberado para o “dedo”.

Como salvar 40 milhões de dados de treinamento

DeepSeek rastreou todos os conjuntos de dados com o rótulo "detecção de alvo" de plataformas como Huggingface e inicialmente rastreou 97.984 dados fonte.

Em seguida, fizemos duas rodadas de triagem.

A primeira rodada de verificação da qualidade da etiqueta. Use a IA para revisar automaticamente três tipos de perguntas: os rótulos são números numéricos sem sentido (categorias denominadas "0" e "1"), os rótulos são entidades privadas ("MyRoommate") e os rótulos são abreviações vagas ("OK" e "NG" em testes industriais, uma maçã "OK" e uma placa de circuito "OK" parecem completamente diferentes e a IA não consegue aprendê-los). Esta rodada teve um corte de 56%, restando 43.141.

A qualidade da segunda rodada de verificação de quadros. Três critérios: muitas marcas faltantes (marque metade da marca e ela não será marcada), o quadro está torto e metade do objeto está cortado e o quadro é tão grande que enquadra toda a imagem (isso significa que os dados originais são dados de detecção convertidos a partir da classificação da imagem, sem informações de posicionamento). Cortou outros 27%, restando 31.701.

Finalmente, amostra e remove duplicatas por categoria, produzindo mais de 40 milhões de amostras de alta qualidade.

DeepSeek opte por ampliar primeiro os dados da caixa e depois preencher os dados dos pontos. A razão também é simples: se você pedir à IA para marcar uma caixa, a resposta será basicamente única (basta circular o objeto); mas se você pedir à IA para marcar um ponto, qualquer posição no objeto será considerada correta, não haverá uma resposta correta única e o sinal de treinamento ficará muito embaçado. Além disso, o próprio quadro contém dois pontos (canto superior esquerdo e canto inferior direito). Depois de aprender a desenhar o quadro, a pontuação é uma operação de redução de dimensionalidade.

Como ensinar a habilidade do "dedo" ao modelo

A estratégia pós-treinamento é "treinar separadamente primeiro e depois mesclar".

DeepSeek primeiro usa dados de quadro para treinar um modelo especialista especializado em quadros de imagem e, em seguida, usa alguns dados para treinar um modelo especialista especializado em pontuação. A razão para o treinamento separado é porque a quantidade de dados não é grande o suficiente e as duas habilidades são fáceis de interferir uma na outra quando misturadas.

Em seguida, execute o aprendizado por reforço nos dois especialistas, respectivamente. Como avaliar se o modelo “desenha o quadro certo” ou “segue o caminho certo”? DeepSeek projetou um sistema de pontuação multidimensional: o formato está correto (a sintaxe das coordenadas está correta), a lógica não é razoável (o processo de pensamento é contraditório) e a resposta é precisa (quão diferente é o resultado final da resposta padrão).

A triagem de dados de aprendizagem por reforço também é muito particular: primeiro deixe o modelo fazer a mesma pergunta N vezes. As questões que estão todas corretas são muito fáceis e não têm valor de treinamento, e as questões que estão todas erradas são muito difíceis de aprender alguma coisa. Apenas as questões "algumas certas e outras erradas" são deixadas para prática.

A etapa final é combinar as capacidades dos dois especialistas em um modelo. Abordagem específica: Deixe o modelo unificado aprender de acordo com a produção de dois especialistas, semelhante a um aluno aprendendo matérias diferentes com dois professores ao mesmo tempo.

Como conta depois de dar os dedos

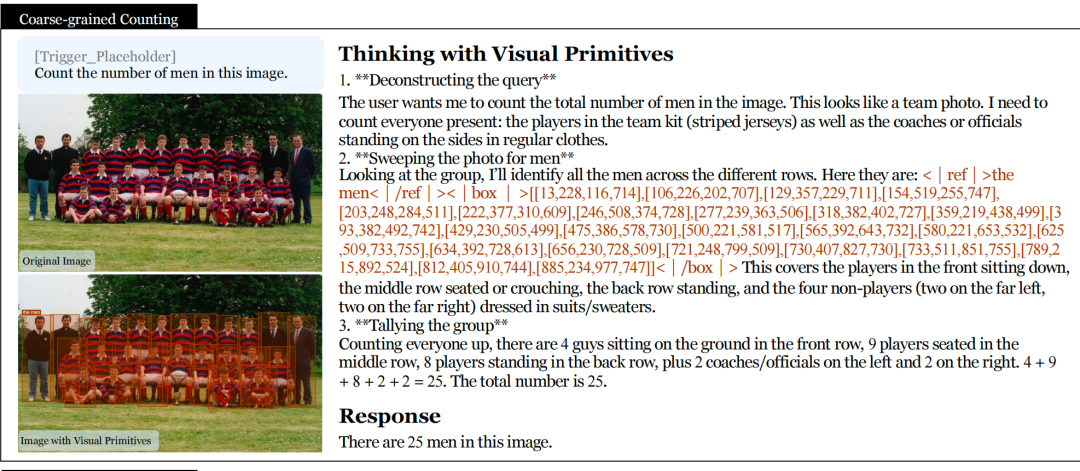

Conte 25 Pessoal

Dê ao modelo Digite uma foto de um time de futebol e pergunte "Quantas pessoas estão na foto?"

Processo de pensamento: Primeiro determine "Esta é uma foto de um time, conte todos, incluindo jogadores e treinadores." Em seguida, imprima 25 coordenadas de quadro de uma vez e circule um quadro em cada pessoa. Depois conte de acordo com o número de filas: 4 pessoas sentadas na primeira fila + 9 pessoas na fila do meio + 8 pessoas na fila de trás + 2 treinadores à esquerda + 2 treinadores à direita = 25.

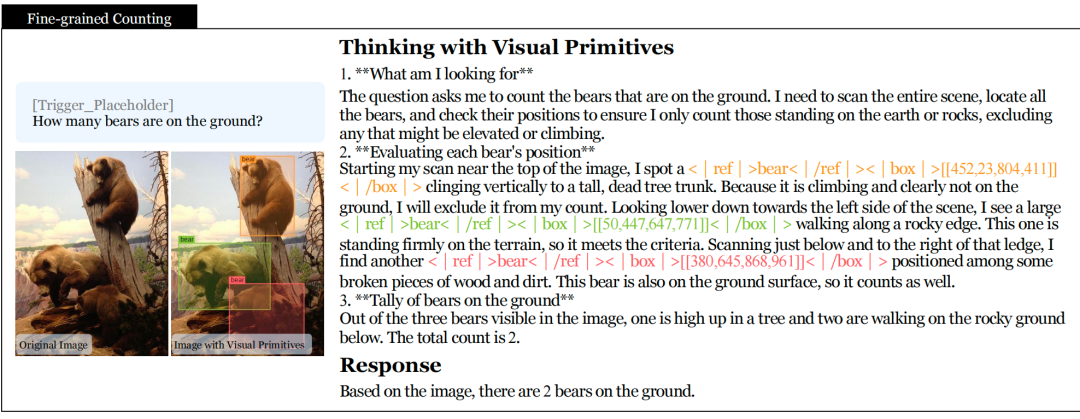

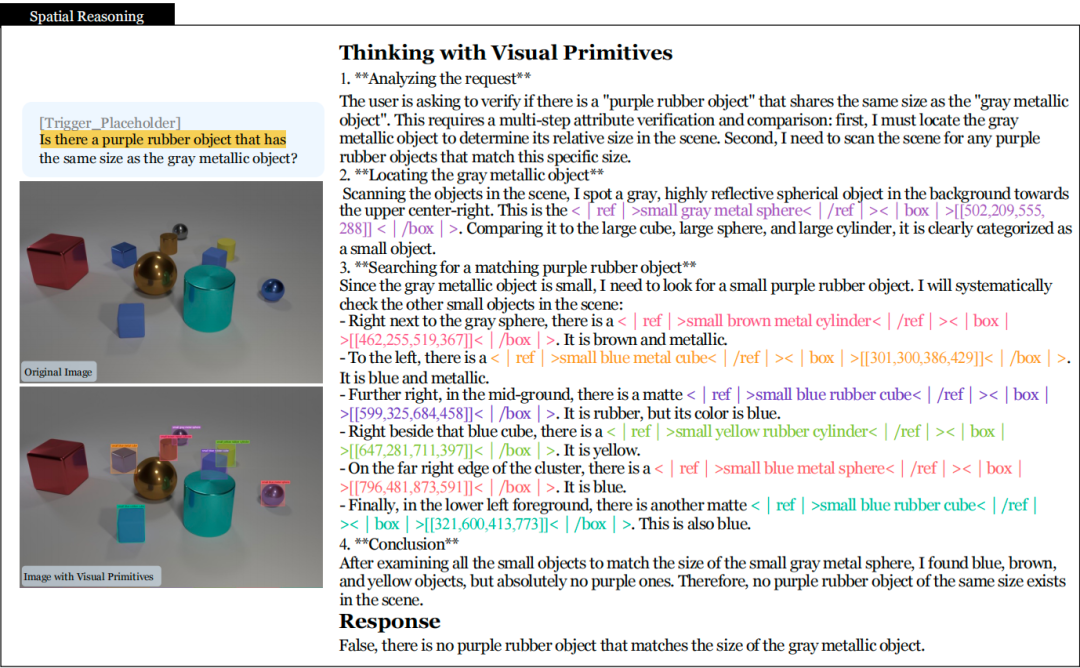

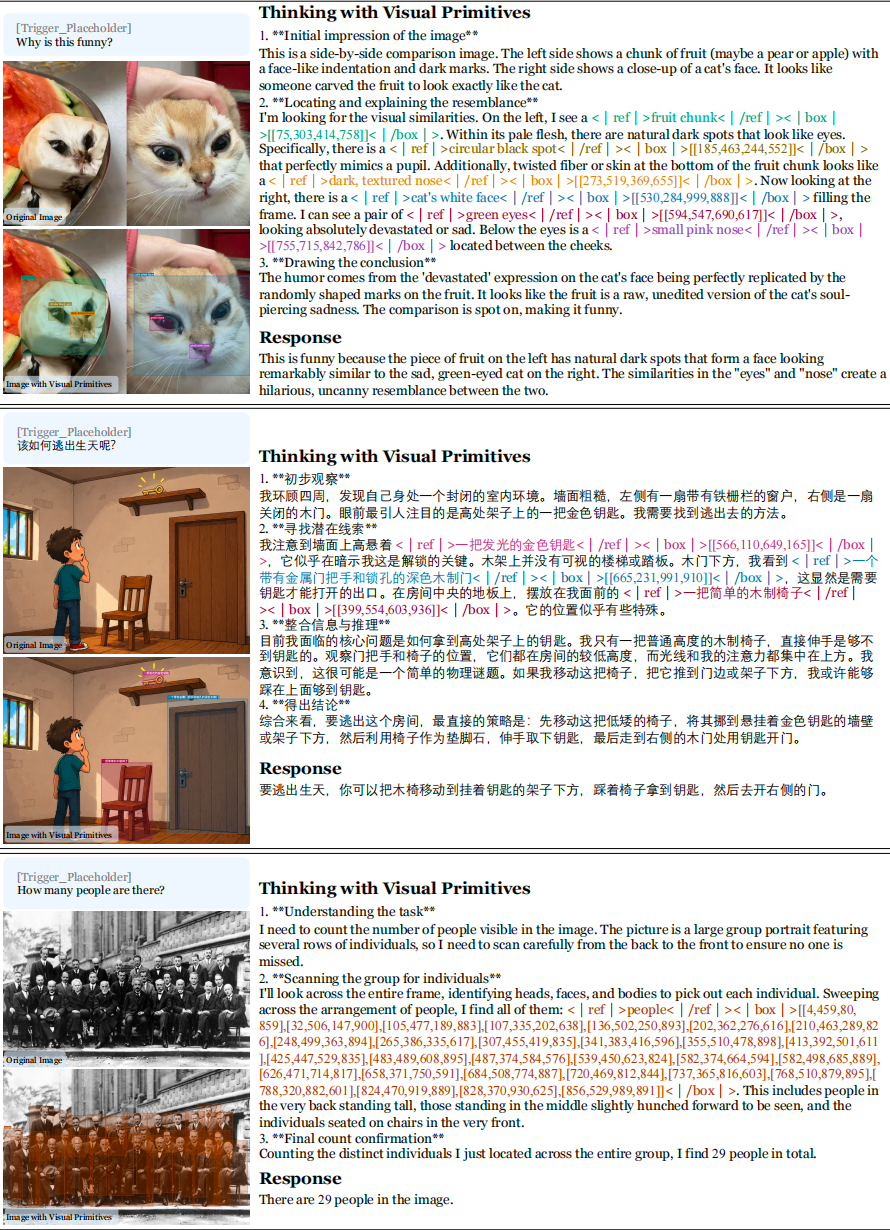

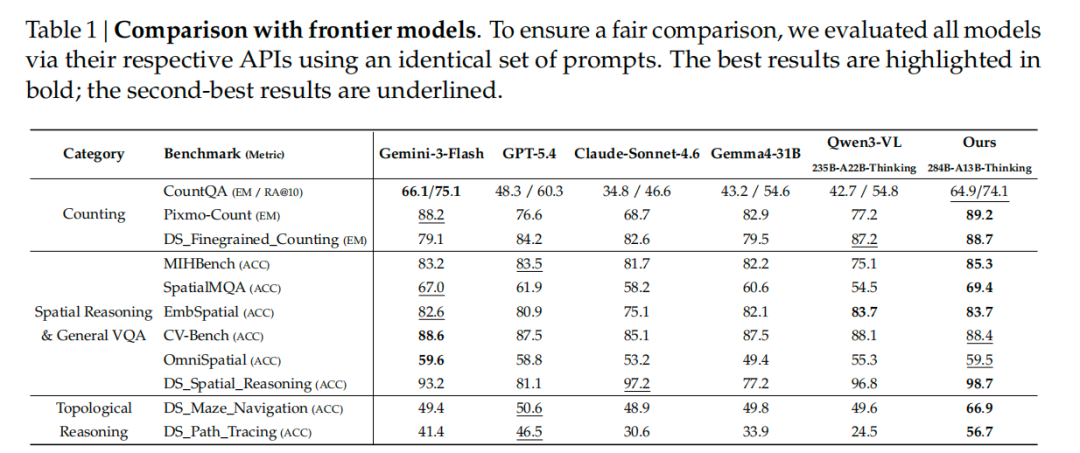

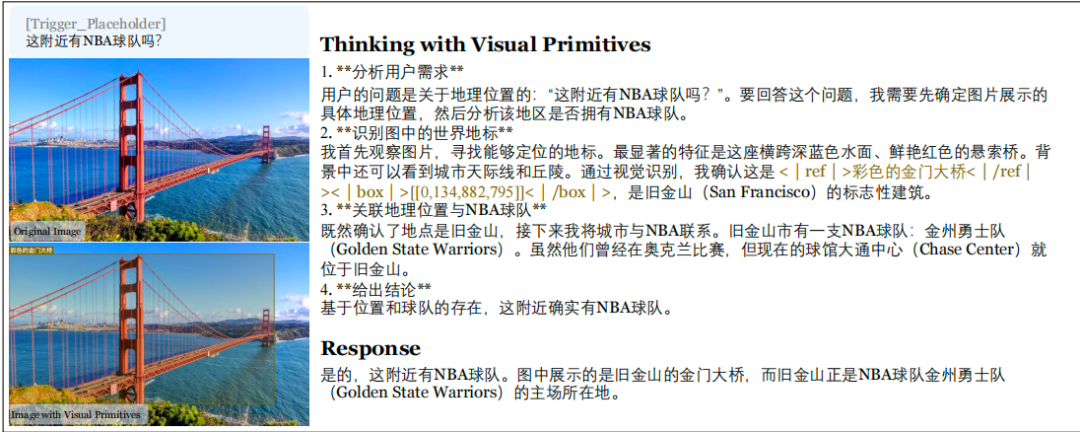

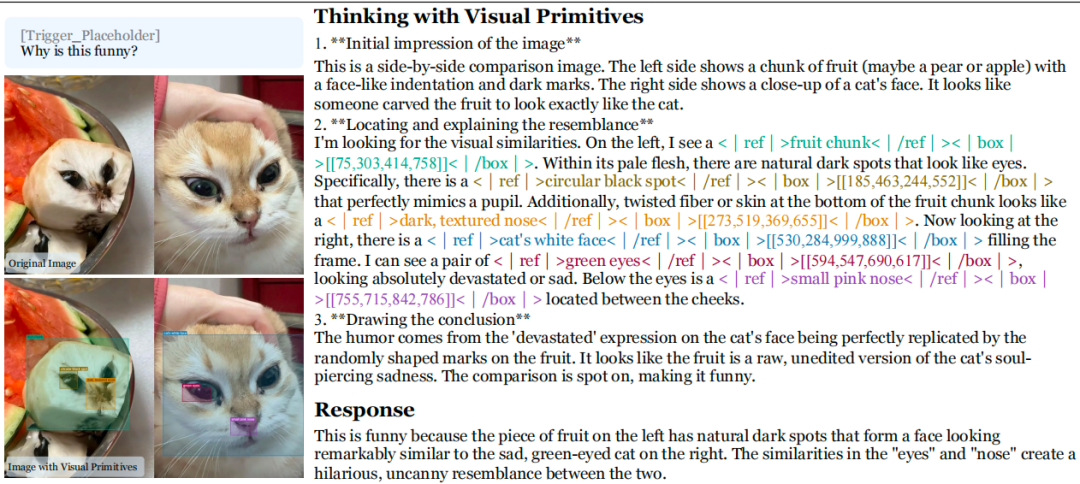

“Quantos ursos há no chão?” PH38 Existem três ursos na foto. O modelo dá cada quadro um a um e determina sua posição: o primeiro sobe verticalmente no tronco da árvore e o exclui; o segundo caminha até a beira da rocha e conta; o terceiro entre a madeira quebrada e o solo, conta. Resposta: 2. Em vez de contar três e depois subtrair um, cada um é julgado como "se está no chão". Há uma âncora coordenada específica por trás de cada julgamento. Na verdade, é verificar as coisas uma por uma, não adivinhar. Raciocínio espacial multi-hop A 3D Há um monte de geometrias coloridas na cena renderizada. Pergunta: "Existe um objeto de borracha roxa que seja tão grande quanto um objeto de metal cinza?" O modelo primeiro enquadra a esfera de metal cinza para confirmar que é um objeto pequeno. Em seguida, enquadre outros pequenos objetos na cena, um por um: cilindro de metal marrom, quadrado de metal azul, quadrado de borracha azul, cilindro de borracha amarelo... Os seis objetos são verificados um por um, e os três atributos de cor, material e tamanho são verificados um por um. Conclusão: Não existe borracha roxa. Seis tempos de posicionamento e seis tempos de julgamento. Cada etapa é ancorada por coordenadas, portanto não haverá "espere um minuto, onde você encontrou?" situação. Mais referências de casos no artigo: Navegação no labirinto: outra pessoa joga uma moeda, DeepSeek Realmente procurando por O artigo testou quatro tarefas, e o labirinto era aquele com a maior lacuna. A tarefa é muito simples: dado um diagrama de labirinto, pergunte se existe um caminho do ponto inicial ao ponto final e, em caso afirmativo, desenhe-o. Existem três formatos de labirintos: quadrado, anel e favo de mel. A forma como a modelo navega pelo labirinto é a mesma de quando você usava um lápis para desenhar no papel quando era criança: escolha um caminho de ramificação e vá até o final. Se não funcionar, volte e tente outro. A diferença é que a cada passo que dá, ele marca um ponto coordenado no mapa e deixa um registro. O artigo mostra o processo completo de um labirinto circular: o modelo primeiro marca o ponto inicial e o ponto final e depois começa a explorar. Depois de caminhar 18 passos, entrei duas vezes em um beco sem saída e saí. Finalmente, encontrei um caminho e conectei os pontos coordenados de todo o caminho à saída. DeepSeek também projetou um lote de labirintos de armadilhas: há um caminho à primeira vista, mas uma certa seção no meio está secretamente bloqueada. Esse tipo de labirinto testa a paciência. O modelo não pode tirar conclusões apenas observando a tendência perto do ponto de partida. Tem que tentar todos os caminhos possíveis para confirmar que não funciona. Comparação de precisão: - DeepSeek: 66,9% - GPT-5.4: 50,6% - Claude-Soneto-4.6: 48,9% - Gêmeos-3-Flash: 49,4% - Qwen3-VL: 49,6% Existem apenas duas respostas para o labirinto: há um caminho ou não há caminho. Uma estimativa aleatória é exatamente 50%. GPT, Claude, Gemini e Qwen estão todos oscilando em torno de 50%, o que não é diferente de jogar uma moeda. Os 66,9% do DeepSeek não são altos, mas é de fato uma abordagem passo a passo, não uma tarefa tola. Tracing de caminho: a versão definitiva onde todos encontram falhas Esta tarefa é mais intuitiva: um monte de fios emaranhados, cada fio levando de um marcador a outro. A aparência do fio do fone de ouvido quando você o tira do bolso é a aparência da imagem. A questão pergunta: a que ponto final esta linha leva? O modelo serve para gerar pontos coordenados ao longo da linha, como um dedo cruzando o papel. Onde a linha é curva acentuadamente, os pontos são marcados densamente e os segmentos retos são marcados esparsamente. O mesmo acontece quando as pessoas seguem uma linha com os olhos. Eles diminuem a velocidade nas curvas e percorrem linhas retas. O papel também adiciona uma versão difícil do teste: todas as linhas têm a mesma cor e espessura. Você não pode mais distinguir qual linha é pela cor, você só pode confiar na continuidade da tendência da própria curva para determinar qual linha a interseção deve seguir. - DeepSeek: 56,7% - GPT-5.4: 46,5% - Claude-Soneto-4.6: 30,6% - Gemini-3-Flash: 41,4% Os 30,6% de Claude são um pouco inesperados. Geralmente há quatro ou cinco opções para o ponto final, e a adivinhação aleatória deve ser superior a 20% e 30,6% é apenas um pouco melhor do que a adivinhação cega. Talvez a inércia do raciocínio verbal não seja útil neste tipo de tarefa de rastreamento puramente espacial. Como ensinar IA Andando no labirinto sem trapacear Há um problema prático no treinamento do labirinto: se você der pontos apenas com base na resposta final correta ou não, o modelo aprenderá rapidamente. Em vez de pesquisar muito e errar a resposta, é melhor apenas adivinhar uma. De qualquer forma, se você for com cuidado e responder corretamente a pergunta, a pontuação será zero. A solução do DeepSeek é incluir o processo na pontuação. Os pontos são concedidos para cada etapa da exploração legal, os pontos são deduzidos por atravessar paredes e, quanto mais longe você for, melhor. Mesmo que você não alcance a linha de chegada no final, contanto que pesquise com cuidado a maior parte da área, ainda poderá obter bons resultados. Dessa forma, o modelo não tem incentivo para ser preguiçoso. Labirintos insolúveis têm requisitos mais elevados: você não pode simplesmente dizer “não funciona”, você também precisa provar que realmente visitou todos os lugares que pode ir. A cobertura da pesquisa também conta. Um ovo de páscoa, três limitações Não há chinês nos dados de treinamento. Mas o modelo pode fazer raciocínio visual primitivo em chinês. Dê a foto de uma máquina de café e pergunte "Como fazer um café com leite" em chinês. Ele marca as coordenadas de posição do tubo de vapor, da jarra de leite, dos grãos de café e dos botões do café com leite em chinês e, em seguida, fornece as etapas de operação. Os recursos multilíngues são herdados do modelo básico e não são destruídos pelo treinamento em primitivos visuais. Também pode combinar a visualização de imagens com o conhecimento do mundo: recebeu uma foto da Ponte Golden Gate e perguntou "Existe uma NBA por perto?" Equipe?" Ele emoldurou a ponte Golden Gate, raciocinando que era São Francisco, e então respondeu aos Golden State Warriors. pode entender o humor: as manchas naturais em um pedaço de fruta cortado compõem exatamente o rosto de um gato triste, e o modelo pode apontar as semelhanças e explicar por que é engraçado .Pode fornecer orientação para a sala de fuga: enquadre a chave no alto, a cadeira no chão e a porta trancada e sugira "mova a cadeira sob a chave → pise nela para pegar a chave → abra a porta". O jornal escreve francamente sobre coisas que atualmente são impossíveis. A resolução de entrada é limitada. A saída do ViT está presa entre 81 e 384 unidades de informação visual. Ao encontrar cenas muito detalhadas (como contar os dedos), a precisão das coordenadas não é suficiente. Esta pode ser a razão direta pela qual o carro capotou enquanto contava nos dedos durante o teste real de anteontem. Atualmente requer uma palavra-gatilho específica para ativar o modo visual primitivo. O modelo ainda não pode julgar por si só “Devia esticar os dedos para resolver este problema”, alguém tem que lembrar. O raciocínio topológico tem capacidades de generalização limitadas. O efeito é bom no tipo de labirinto treinado, mas pode diminuir ao mudar para uma nova estrutura espacial. Chen Xiaokang também disse naquele tweet excluído: "Ainda estamos nos estágios iniciais; a generalização em tarefas complexas de raciocínio topológico ainda não é perfeita, mas estamos comprometidos em resolvê-la." continuará a resolvê-lo.” Durante o teste real anteontem, as capacidades demonstradas pelo modo de reconhecimento de imagem do DeepSeek (pedindo a identidade do editor, logotipo da baleia Lenovo) significam autocorreção, proporcionando a si mesmo uma “mini-reunião de defesa”), o que é consistente com a forma de pensar descrita neste artigo. Ele estabelece um ponto de ancoragem visual no cérebro, raciocina em torno do ponto de ancoragem e volta para corrigi-lo ao encontrar conflitos. E contar os dedos me deixa tonto, esta é a demonstração viva do Reference Gap. Na imagem dos dedos sobrepostos, confiar puramente em descrições verbais para distinguir “o terceiro da esquerda” e “o segundo da direita” é o mesmo que contar um grupo de pessoas aglomeradas sem esticar os dedos, o que está fadado ao caos. A direção que este artigo aponta é: a próxima evolução do raciocínio multimodal está no mecanismo de ancoragem. DeepSeek usa 90 unidades de informação para igualar o efeito de outras usando milhares de tokens, e todo o poder de computação economizado é usado para permitir que o modelo “pense e aponte ao mesmo tempo”. A corrida armamentista de resolução pode ser desacelerada um pouco ensinando o modelo a estender os dedos em vez de equipá-lo com um par de óculos mais caros. Depois que a baleia abriu os olhos, também cresceram dedos. A taxa de precisão do labirinto de 66,9% está longe de ser perfeita, mas pelo menos está sendo levada a sério, ao contrário dos vizinhos que estão jogando uma moeda.