Os modernos geradores de imagens de IA estão evoluindo rapidamente, e as falhas que eram visíveis à primeira vista nos primeiros dias – como mãos e pés deformados, texto bagunçado e ruídos estranhos na imagem – estão gradualmente sendo eliminadas por meios de engenharia. Hoje em dia, muitas imagens sintéticas são suficientes para enganar os olhos do cidadão comum e se espalhar de forma incontrolável nas redes sociais. No entanto, um estudo publicado na revista Science aponta que estes modelos ainda “não compreendem” essencialmente como a luz e a geometria funcionam no mundo real, e as leis físicas estão a tornar-se uma das ferramentas mais fiáveis para identificar imagens autênticas e falsas.

Os pesquisadores apontaram que, desde que o reflexo, a sombra, a linha de perspectiva e outras partes aparentemente triviais sejam medidas, ainda há uma chance de revelar uma foto de IA aparentemente perfeita. Este método de verificação baseado na consistência do mundo físico é considerado pelos especialistas forenses digitais como uma importante linha de defesa para distinguir fotos reais de falsificações de IA na era das “falsificações profundas”. A identificação precoce muitas vezes dependia do olho nu para capturar falhas técnicas grosseiras, mas à medida que a qualidade da produção melhorou, as imagens começaram a se conformar cada vez mais às expectativas subjetivas humanas de “realidade” – cores brilhantes, composições dramáticas e cheias de sentimento cinematográfico. Este “drama fabricado” tornou mais fácil para as pessoas relaxarem a vigilância.

Hany Farid, professor da Universidade da Califórnia, Berkeley, e amplamente considerado um dos fundadores do campo da análise forense digital, tem explorado outra “fraqueza oculta” das imagens de IA. Sua abordagem não consiste em procurar erros visuais óbvios, mas em comparar as imagens geradas com as relações geométricas que deveriam aparecer no mundo real. Na sua opinião, os modelos existentes de geração de imagens ainda não aprenderam verdadeiramente o conceito básico nas aulas de arte - ponto de fuga.

Pegue uma imagem gerada por IA de "soldados marchando no corredor" como exemplo. Você pode ver algumas falhas óbvias na imagem, como texto borrado e difícil de ler na parede, correntes inexplicáveis, etc. Mas a pista mais crítica está escondida nos ladrilhos do chão: de acordo com o princípio da perspectiva, as linhas paralelas na realidade (como as costuras dos ladrilhos e dos pisos de madeira) devem se estender e convergir para o mesmo ponto de fuga na imagem. Se você desenhar linhas ao longo dessas estruturas com a ferramenta Linha, poderá verificar se elas se encontram à distância, como em uma foto real, dando uma ideia inicial se a imagem é confiável.

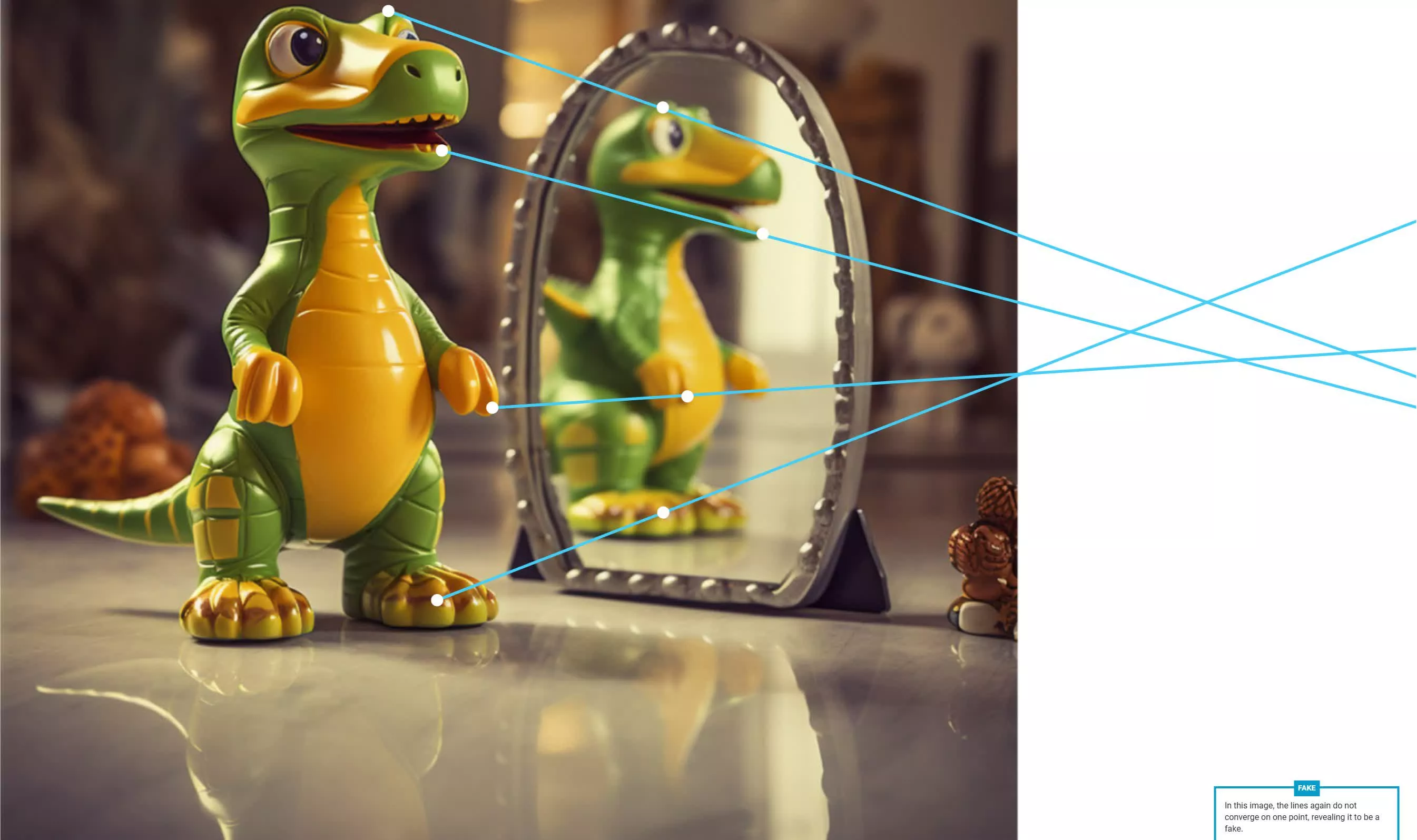

Relações geométricas semelhantes também se aplicam a reflexões. A pesquisa aponta que embora os modelos generativos atuais já possam sintetizar água ou reflexões especulares suficientes para enganar o olho humano, os problemas ficarão expostos desde que você pegue uma régua para medi-los. No mundo real, as linhas que ligam um determinado ponto de um objeto e seu correspondente ponto de reflexão devem ser paralelas entre si e apontar para o mesmo ponto de fuga após serem estendidas; uma vez que essas linhas parecem ter desvios indevidos, é provável que signifique que se trata de uma imagem composta.

As sombras projetadas pelo sol também fornecem aderência adicional para este tipo de teste. Como o Sol está extremamente distante da Terra, pode-se considerar aproximadamente que a luz solar que atinge o solo é uma luz paralela. Sob esta premissa, a linha entre um determinado ponto do objeto e seu ponto correspondente na sombra também deve poder ser estendida e convergir para um ponto de fuga. Se as linhas de sombra de diferentes objetos em uma foto não puderem apontar para uma relação geométrica consistente, é provável que isso viole as leis básicas da óptica.

Atualmente é difícil prever quando e se os modelos generativos podem superar fundamentalmente esses erros de nível físico. Em comparação com as falhas que eram facilmente discerníveis a olho nu nos primeiros dias, a "verificação geométrica" baseada na perspectiva e na luz exige que os observadores gastem mais tempo e energia, excedendo em muito o limite de vigilância diária do utilizador médio das redes sociais. Alguns investigadores acreditam mesmo que uma compreensão profunda de tais regras físicas pode estar além das capacidades de design dos atuais modelos generativos convencionais.

Além deste trabalho, os especialistas também lembram os usuários de serem cautelosos ao "usar IA para identificar IA". Algumas ferramentas de detecção automática podem de fato ser mais confiáveis do que o olho humano não treinado sob certas condições, mas uma vez que a distribuição da imagem de entrada e seus dados de treinamento sejam muito diferentes, o algoritmo sofrerá erros e até mesmo vieses sistemáticos. Em outras palavras, entregar completamente a tarefa de triagem a outro modelo de caixa preta não é uma solução infalível.

Um estudo relacionado também fez uma descoberta intrigante: confirmar que uma foto é “real” pode ser mais difícil do que identificar uma “falsa”. O estudo descobriu que quanto mais tempo um espectador olha para uma imagem sem encontrar uma falha, maior é a probabilidade de se tratar de uma fotografia real. Nessa perspectiva, o próprio “nenhum erro encontrado” pode se tornar uma das evidências de autenticidade.