Em um evento especial do Android na véspera da I/O Developers Conference deste ano, o Google mais uma vez se concentrou em seu próprio modelo Gemini de uso geral e anunciou uma série de novos recursos focados em “ajudar você a controlar seu telefone”. Esses recursos aparecerão no navegador Chrome, no preenchimento automático de formulários do sistema e em mais cenários de aplicativos.

O Google também lançou um novo nome conceitual – “Gemini Intelligence”. De acordo com Ben Greenwood, diretor de experiência do Google Android, esse nome representa “liberar os melhores recursos do Gemini nos dispositivos Android mais avançados”. É essencialmente um pacote de integração de recursos novos e existentes e é direcionado principalmente a modelos topo de linha, como o Galaxy S26, formando um conjunto de recursos semelhante a uma “experiência Android avançada”.

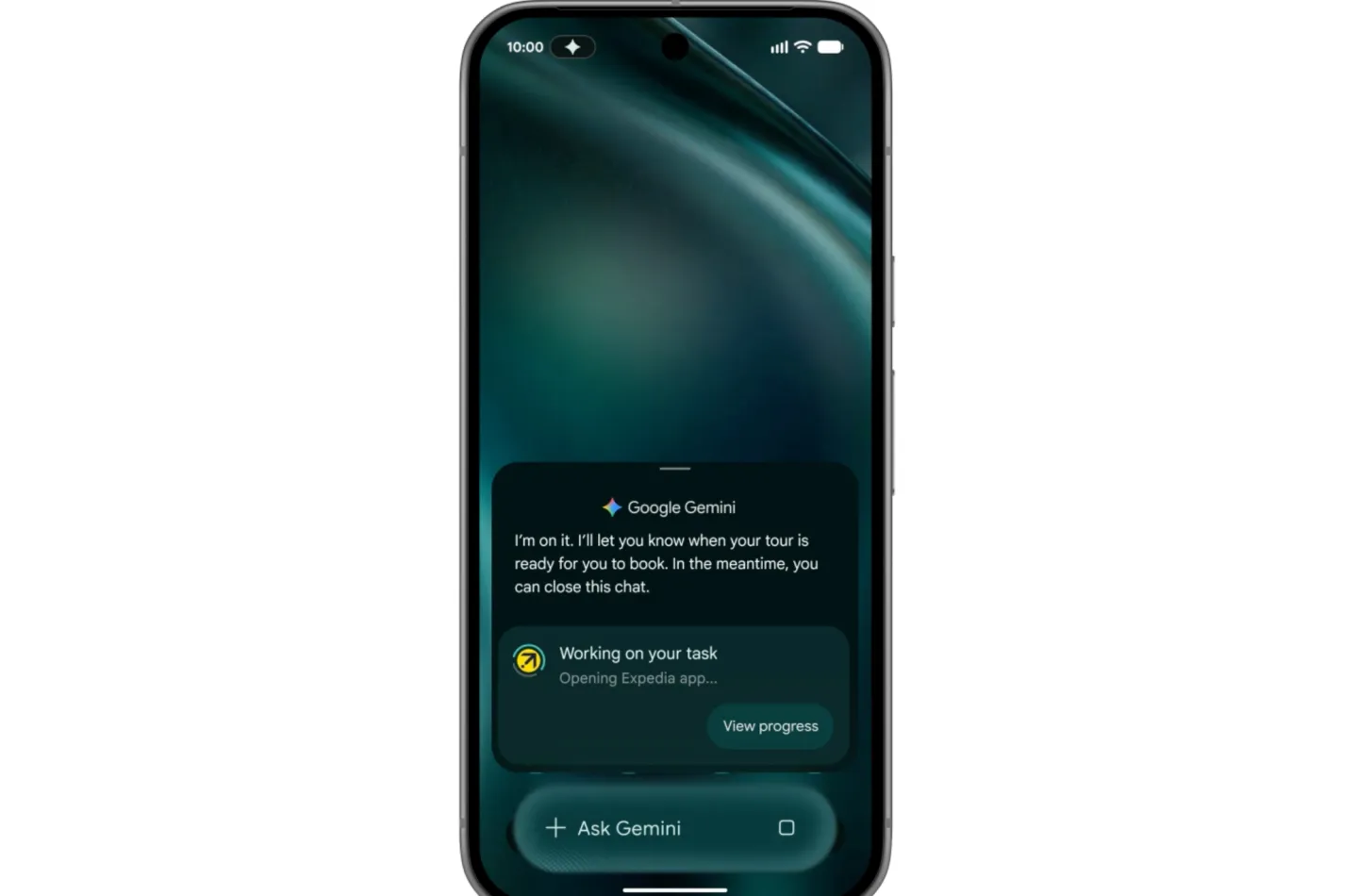

No centro desta coleção estão os recursos de automação de tarefas que foram testados anteriormente em alguns novos telefones Pixel e Samsung Galaxy. Este recurso permite que o Gemini opere aplicativos específicos diretamente no telefone. Anteriormente, ele suportava principalmente alguns aplicativos, como carona e entrega de comida. Agora, o Google anunciou que será aberto a um ecossistema de aplicativos mais amplo “em breve”. Além disso, a automação de tarefas também será atualizada, passando do suporte apenas a comandos de voz e texto para entrada multimodal. Os usuários podem desencadear ações por meio de capturas de tela ou fotos. Por exemplo, forneça ao Gemini uma captura de tela de uma lista de compras no aplicativo de notas e ele adicionará automaticamente um carrinho de compras à plataforma de comércio eletrônico ou compras de supermercado – desde que o próprio dispositivo suporte Gemini Intelligence.

Sob Gemini Intelligence, o Google também anunciou pela primeira vez um novo recurso chamado “Create My Widget”, que é oficialmente considerado o primeiro passo em direção à “UI generativa”. Os usuários só precisam descrever as funções do widget que desejam em linguagem natural e o Gemini gerará automaticamente os componentes de desktop correspondentes. Os exemplos dados pelo Google incluem: personalizar um componente climático que destaca a velocidade do vento e a probabilidade de precipitação para entusiastas do ciclismo, ou um componente de receita que recomenda automaticamente “três receitas de preparação de refeições ricas em proteínas” todas as semanas. Após a geração, esses componentes não aparecerão apenas na área de trabalho do telefone móvel, mas também serão expandidos para relógios inteligentes Wear OS simultaneamente, formando uma experiência unificada entre dispositivos.

Do ponto de vista do conceito de interação, o Google espera que os usuários considerem os componentes como “miniaplicativos que podem ser facilmente escritos no desktop usando IA”, promovendo assim a evolução das formas de interface em direção à geração instantânea e mudanças sob demanda. A indústria também está prestando atenção se o Google explicará melhor o caminho de longo prazo da "UI generativa" na conferência I/O: se permitirá que a interface seja realmente reconstruída instantaneamente de acordo com a cena, ou se será mais uma tentativa personalizada no nível do componente.

Além das funções de nível de sistema, o Google também migrou alguns dos recursos de desktop do Gemini para a versão Android do navegador Chrome. No futuro, os usuários verão um botão Gemini independente no Chrome, que pode compartilhar diretamente o conteúdo atual da página da web com o Gemini e fazer perguntas ou gerar um resumo das informações da página no navegador. Para usuários que assinam o plano Google AI Pro ou Ultra, o Chrome também fornecerá “navegação automática” para auxiliar na conclusão de tarefas, como alternar automaticamente entre sites, preencher informações e concluir compromissos. Espera-se que esse recurso seja implementado gradualmente no final de junho.

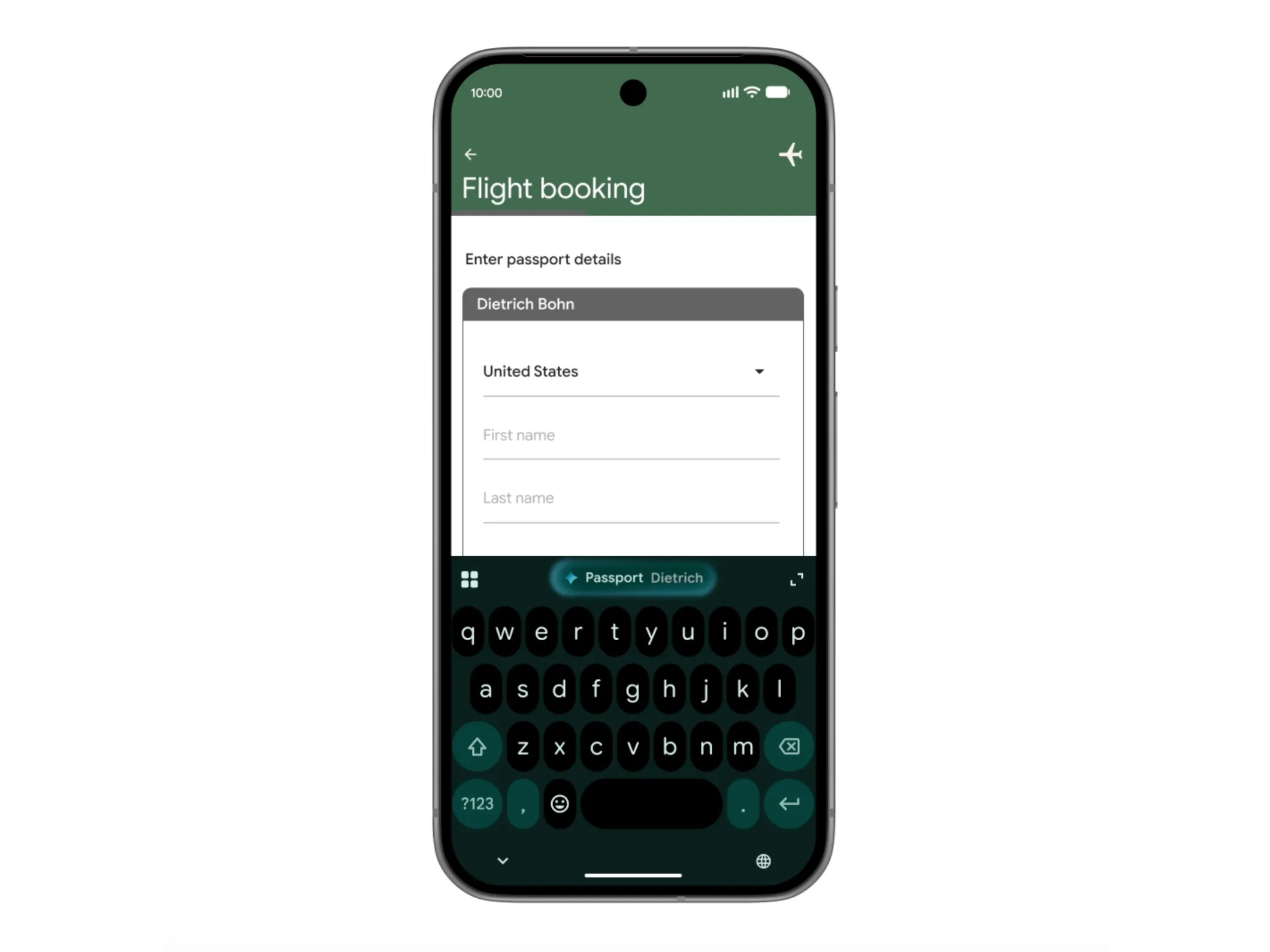

Em termos de outra entrada importante na camada do sistema - o preenchimento automático de formulários, o Gemini também intervirá "condicionalmente" mais profundamente. O Google disse que os usuários podem optar por conectar o Gemini à função de preenchimento automático do Android para ajudar a preencher vários formulários. Para isso, a Gemini usará sua interface chamada “Inteligência Pessoal” para recuperar informações relevantes de fontes de dados pessoais como Google Fotos e Gmail com autorização, como identificação automática de números de placas em fotos e preenchimento de formulários. Por um lado, esta abordagem melhorou significativamente a eficiência do preenchimento. Por outro lado, também desencadeou uma nova discussão sobre a fronteira entre privacidade e conveniência - se é "extremamente atencioso" ou "um pouco estranho" cabe ao utilizador julgar.

De acordo com o plano do Google, diversas funções do Gemini Intelligence serão lançadas “em lotes e de acordo com a maturidade” este ano. O primeiro lote de objetos push ainda serão modelos Android de última geração, como Samsung Galaxy e Google Pixel, e espera-se que receba atualizações a partir deste verão.