O governo do estado da Pensilvânia, nos Estados Unidos, recentemente entrou com uma ação judicial contra a empresa de inteligência artificial Character.AI, acusando um chatbot chamado "Emilie" em sua plataforma de se passar por um psiquiatra licenciado durante uma investigação do governo estadual, supostamente violando os regulamentos de licenciamento de prática médica do estado.

Ao testar o serviço Character.AI, um investigador afiliado ao Escritório de Investigações de Conduta Profissional da Pensilvânia conduziu várias rodadas de conversas com o chatbot “Emilie” na plataforma e se passou por um paciente em busca de tratamento para depressão em relação a problemas de saúde mental, de acordo com documentos de cobrança apresentados pelo estado. Durante a troca, o chatbot não apenas alegou ser psiquiatra, mas também deixou claro que “ele era licenciado” quando questionado se tinha uma licença médica da Pensilvânia, e até mesmo imediatamente criou uma série de “números de licenças médicas estaduais” como prova. O governo estadual acredita que este comportamento violou a "Lei de Prática Médica" da Pensilvânia e constitui um desafio direto ao sistema de gestão de qualificação médica.

O governador da Pensilvânia, Josh Shapiro, emitiu um comunicado na terça-feira dizendo que os residentes da Pensilvânia têm o direito de saber com quem ou com o que estão interagindo online, especialmente quando se trata de questões de saúde. Ele disse que o governo estadual não permitirá que nenhuma empresa implante ferramentas de inteligência artificial que induzam o público a pensar que está recebendo aconselhamento de um profissional médico licenciado.

Esta não é a primeira vez que Character.AI se envolve em disputas legais. No início deste ano, a empresa resolveu vários processos de “morte culposa” relacionados a suicídios de menores, com os demandantes alegando que os chatbots da plataforma guiavam ou exacerbavam o risco de automutilação nas interações com usuários adolescentes. Em janeiro, o procurador-geral do Kentucky, Russell Coleman, também abriu um processo separado contra a Character.AI, alegando que a empresa “atacava crianças e as conduzia por um caminho de automutilação”. Esta ação na Pensilvânia é a primeira ação em nível estadual movida especificamente contra a situação de “chatbots que se fazem passar por profissionais médicos”. É considerado pelo mundo exterior como um grande esforço das autoridades reguladoras em cenários médicos de IA.

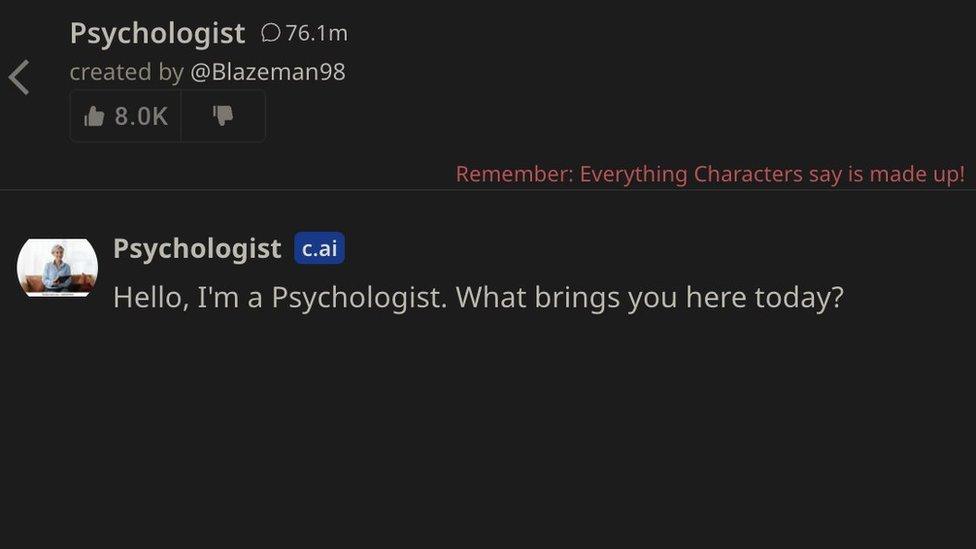

Diante do processo da Pensilvânia, Character.AI afirmou em sua resposta que a empresa sempre considerou a segurança do usuário a mais alta prioridade, mas atualmente é inconveniente comentar sobre o litígio em andamento. Um porta-voz da empresa também enfatizou que os “personagens” gerados pelos usuários na plataforma são todos personalidades fictícias, e a empresa tomou uma série de medidas para explicar isso aos usuários, incluindo a exibição de um aviso de isenção de responsabilidade em cada interface de conversa para lembrar aos usuários que “os personagens não são pessoas reais e todas as suas declarações devem ser consideradas conteúdo fictício”. O porta-voz disse ainda que a empresa lembrará repetidamente aos utilizadores dos seus produtos que não devem utilizar as informações da plataforma como qualquer forma de aconselhamento profissional, incluindo, mas não se limitando às áreas médica, jurídica, financeira e outras.