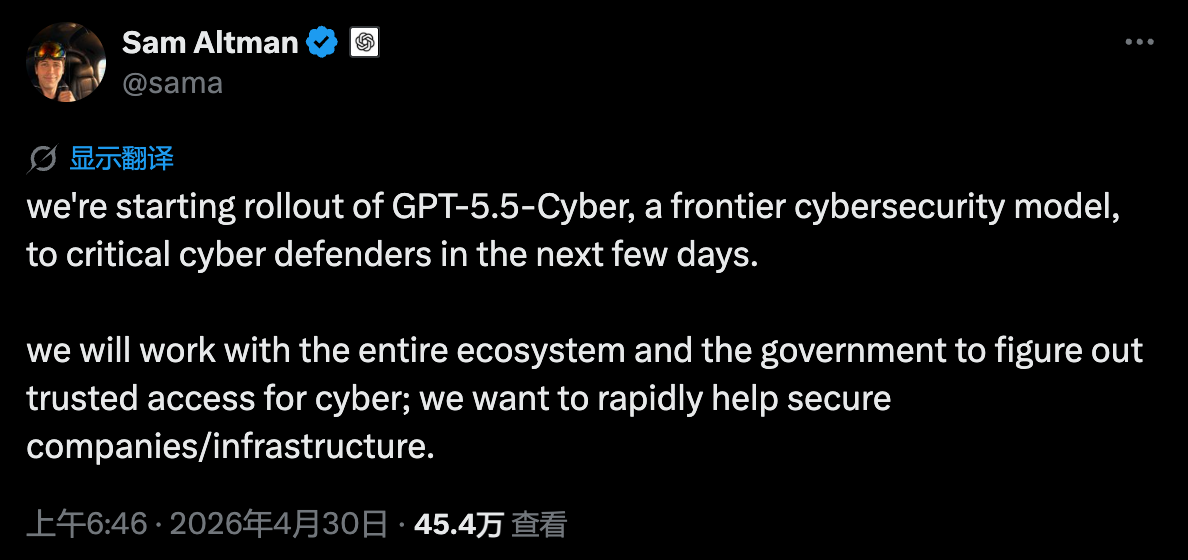

OpenAI está se preparando para lançar um novo modelo de segurança de rede de ponta GPT-5.5-Cyber. O CEO da empresa, Sam Altman, disse que este modelo não será aberto ao público, mas primeiro será fornecido a um grupo de "defensores cibernéticos" selecionados e confiáveis para ajudar as instituições relevantes a fortalecer suas próprias capacidades de proteção de segurança de rede.

De acordo com Altman na plataforma Ao mesmo tempo, a OpenAI também cooperará com todo o ecossistema da indústria e com o governo dos EUA para estudar como estabelecer um mecanismo de “acesso confiável” para a área de segurança de rede.

Atualmente, a OpenAI ainda não especificou o primeiro lote de objetos específicos para obter direitos de uso. No entanto, a julgar pelo programa “Trusted Access” lançado anteriormente pela empresa, os acordos relevantes são geralmente para profissionais e instituições avaliados. Em relação aos detalhes técnicos, limites de capacidade e especificações específicas do próprio GPT-5.5-Cyber, a OpenAI não divulgou mais informações por enquanto.

A julgar pela nomenclatura, o GPT-5.5-Cyber provavelmente será uma versão especializada do GPT-5.5 lançado recentemente. A OpenAI descreveu anteriormente o GPT-5.5 como seu modelo “mais inteligente, mais intuitivo e fácil de usar” até agora. Portanto, acredita-se geralmente que o GPT-5.5-Cyber será um produto derivado baseado nesta base que será direcionado a cenários de segurança de rede para fortalecimento direcionado.

O lançamento de modelos de alta capacidade em etapas e em pequena escala está se tornando uma tendência cada vez mais óbvia na indústria de IA. Muitas empresas começaram a enfatizar que os seus modelos mais avançados não são adequados para serem totalmente abertos ao público devido ao risco de abuso. A OpenAI já adotou uma estratégia de lançamento em lote para seus modelos orientados à segurança de rede; além da segurança de rede, o recém-lançado modelo específico para ciências biológicas da empresa, GPT-Rosalind, também é um produto feito sob medida para campos específicos altamente sensíveis, atendendo principalmente à pesquisa biológica e à descoberta de medicamentos.

Este mês, a Anthropic seguiu um caminho semelhante, lançando Claude Mythos e promovendo vigorosamente seu método de liberação de alta barreira, seguro e controlado. No entanto, a Anthropic cometeu erros bastante embaraçosos durante o processo de liberação de segurança do modelo, o que uma vez fez com que os arranjos relevantes se tornassem controversos.

O relatório também mencionou que, apesar das tensões anteriores entre a Casa Branca e a Antrópica sobre questões relacionadas com o Pentágono, o governo dos EUA ainda está a prestar muita atenção ao processo de lançamento do Mythos. De acordo com o "Wall Street Journal", a Casa Branca recentemente se opôs a uma maior expansão do âmbito de acesso ao Mythos. Isto também reflecte que o governo dos EUA está a demonstrar uma atitude de intervenção cada vez mais directa e cautelosa em relação ao lançamento de modelos de IA de alta capacidade que podem envolver riscos de segurança.