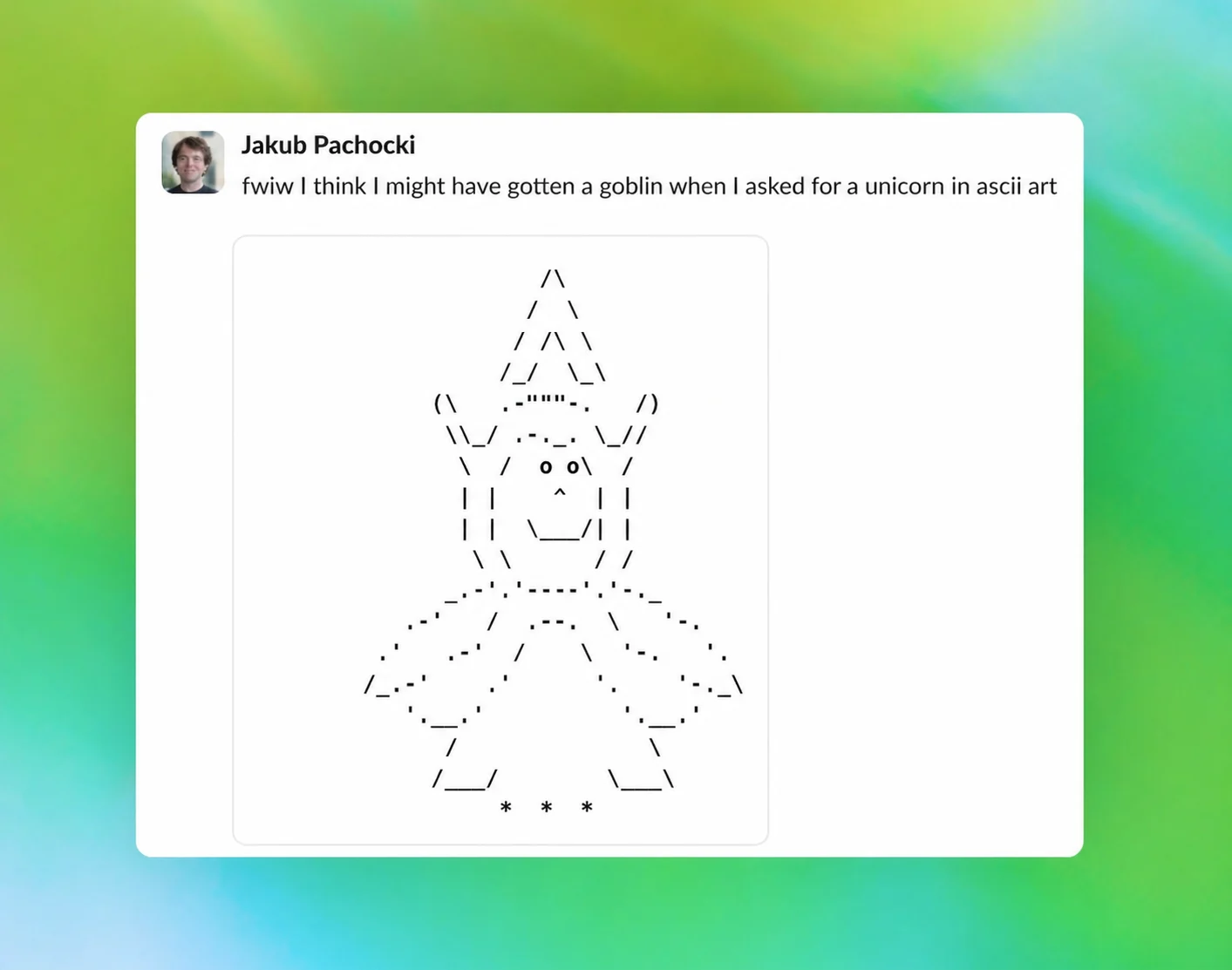

Depois que a "Wired" revelou que a OpenAI deu ao seu modelo de programação uma instrução interna para "nunca falar sobre goblins, gremlins, guaxinins, trolls, ogros, pombos ou outros animais ou criaturas", a OpenAI publicou um artigo em seu site oficial para explicar esse fenômeno, dizendo que se trata de um "hábito estranho" formado pelo modelo durante o processo de treinamento.

A OpenAI afirmou que este tipo de expressão metafórica envolvendo goblins e outras criaturas foi notada claramente pela primeira vez no modelo GPT-5.1, especialmente quando a opção de personalidade “Nerdy” está habilitada. Segundo a empresa, à medida que os modelos subsequentes continuam a iterar, esta forma de expressão não desapareceu, mas espalhou-se gradualmente.

A OpenAI apontou na descrição que a raiz do problema está relacionada ao treinamento de aprendizagem por reforço: embora as recompensas relevantes sejam inicialmente impostas apenas sob a condição de personalidade “Nerdy”, a aprendizagem por reforço não garante que o comportamento aprendido seja sempre estritamente limitado às condições que o desencadearam. Uma vez que um determinado estilo de linguagem ou peculiaridade de expressão é recompensado, os processos de treinamento subsequentes podem propagá-lo para outros cenários, especialmente quando essas saídas são reutilizadas para ajuste fino supervisionado ou treinamento de dados preferenciais. Esta tendência será ainda mais reforçada.

Segundo relatos, como a OpenAI parou de fornecer a personalidade “Nerdy” em março deste ano, tais expressões sobre goblins e gremlins realmente diminuíram, mas não desapareceram completamente. Principalmente no modelo GPT-5.5 utilizado pela ferramenta de programação Codex, pois a OpenAI começou a treinar o modelo antes de identificar a "causa raiz", ainda permanecem nele expressões relevantes.

Por causa disso, a OpenAI teve que adicionar restrições muito específicas ao Codex, exigindo explicitamente que não mencionasse essas criaturas míticas novamente. No entanto, o relatório também mencionou que se alguém quiser que sua IA retenha um pouco desse “estilo Goblin” ao escrever código, a OpenAI até compartilhou publicamente um método que pode ser usado para revogar as restrições relevantes.

A julgar por esta resposta, por trás deste "problema Goblin" aparentemente absurdo, na verdade reflete um problema mais realista no treinamento de grandes modelos: alguns hábitos de linguagem que deveriam aparecer apenas em configurações específicas de personalidade podem se espalhar para uma gama mais ampla de comportamentos de modelo sob o efeito sobreposto do mecanismo de recompensa e treinamento subsequente. Para a OpenAI, esta não é apenas uma explicação pública do estilo de modelo fora de controle, mas também um vislumbre da complexidade que enfrenta ao corrigir desvios comportamentais sutis na IA generativa.