O cientista pesquisador da OpenAI, Chen Boyuan, postou um artigo sobre Zhihu, que começa de forma muito direta:“Olá a todos, sou Chen Boyuan, um cientista pesquisador da equipe GPT Image. O modelo de geração de imagens GPT lançado na semana passada foi meu treinamento principal!”Ele também mencionou que a renderização chinesa do modelo foi finalmente corrigida desta vez. Se os usuários chineses tiverem algum comentário, você poderá respondê-los diretamente.

Após o lançamento do ChatGPT Images 2.0, a primeira reação de muitas pessoas foi:A capacidade chinesa deste modelo é um pouco irracional.

Os modelos de imagem no passado eram um tanto “incompreensíveis”. Eles podem desenhar paisagens e figuras, mas uma vez envolvidos caracteres chineses, eles podem facilmente se transformar em uma confusão indecifrável de símbolos fantasmagóricos. Mas GPT-image-2 é diferente. Ele pode não apenas escrever as palavras corretas, mas também compor, segmentar e gerar gráficos informativos chineses com uma estrutura lógica.

O antigo método de “olhar o texto para determinar se foi gerado pela IA” não funciona mais nesta geração.

Chen Boyuan é uma das pessoas que realmente esteve na recepção no treinamento e demonstração de habilidades do GPT Image 2. Na conferência de imprensa, ele e Ultraman demonstraram as capacidades de renderização de texto. Após o lançamento, ele explicou muitos detalhes por trás das fotos do site oficial em Zhihu: Durante o teste duplo-cego do LMArena, GPT Image 2 usou “fita adesiva” como codinome; muitas fotos no blog do site oficial foram feitas por ele com modelos; Quadrinhos chineses, gravuras de grãos de arroz, textos multilíngues, provas visuais e códigos QR gerados automaticamente. Essas imagens que parecem materiais promocionais são, na verdade, projetadas para testar habilidades continuamente.

Ele usou uma explicação muito interessante para essa fita “fita adesiva”:

"Quanto ao motivo de ser chamada de fita adesiva... claro que é porque você pode usar fita adesiva para colar bananas na parede!"

01

Ele está fazendo uma pergunta mais lenta

Chen Boyuan não é o tipo de pesquisador que pode ser lembrado à primeira vista. Não há discursos públicos frequentes nem gestão deliberada da expressão pessoal. Ele escreve blogs e posta conteúdo alegre, mas estes são mais registros do que construção de influência.

Em contrapartida, sua presença vem mais do próprio modelo.

Atualmente é pesquisador da OpenAI, envolvido no treinamento de modelos de imagens. Antes disso, ele completou um doutorado em engenharia elétrica e ciência da computação no MIT, com especialização em filosofia. Também participou da pesquisa de modelos multimodais no Google DeepMind.

Essas experiências são bastante atraentes, mas o mais importante são suas preocupações de longo prazo.

Do DeepMind ao OpenAI, a direção da pesquisa de Chen Boyuan quase não mudou. Quando a maioria das pessoas ainda está discutindo se o modelo pode ser melhor escrito e desenhado mais de perto, elas estão preocupadas com um nível mais básico: o que o modelo está “compreendendo”.

Especificamente, pode ser visto como três questões: Como o modelo entende a imagem? Qual é a relação entre imagem e linguagem? Quando um modelo enfrenta o mundo real, ele está gerando resultados ou simulando o mundo?

Essas questões parecem abstratas, mas praticamente definem os limites da geração atual de modelos.

Em sua página pessoal, ele escreve sobre sua direção de pesquisa de forma muito direta:Modelos mundiais, inteligência incorporada e aprendizagem por reforço.

O chamado modelo mundial pode ser entendido como uma coisa: permitir que a IA forme um julgamento sobre o mundo internamente.

Ele não deve apenas saber o que está acontecendo à sua frente, mas também ser capaz de prever o que acontecerá a seguir.

Isso é um pouco diferente do LLM (modelo de linguagem grande) comum de hoje. O LLM é mais parecido com uma linguagem de processamento, enquanto o modelo mundial está mais próximo de uma estrutura: precisa compreender o espaço, o tempo, a causa e o efeito e os resultados do comportamento.

Para usar um exemplo muito simples, se a IA realmente “entende” o mundo, ela deveria saber que um copo de plástico irá quicar ao cair no chão, enquanto um copo de vidro irá quebrar.

A inteligência incorporada e a aprendizagem por reforço podem ser entendidas como uma extensão deste problema - se um modelo realmente compreende o mundo, não deve apenas responder a perguntas, mas também deve ser capaz de agir e rever constantemente o seu julgamento durante a acção.

O trabalho em que ele está envolvido muitas vezes não é uma otimização de tarefa única, mas uma tentativa de conectar modelos generativos, compreensão visual e sistemas de tomada de decisão.

Um de seus trabalhos mais representativos é um estudo chamado Diffusion Forcing.

Esta pesquisa tenta resolver uma questão muito básica: o modelo é gerado passo a passo ou é gerado tudo de uma vez?

LLM é o primeiro, que é bom em geração flexível, mas sujeito a erros em conteúdos longos; o modelo de difusão está mais próximo deste último, que é mais estável, mas carece de estrutura.

A abordagem de Chen Boyuan é colocar esses dois métodos no mesmo modelo, para que o modelo possa ser gerado gradualmente e restringir o todo.

Se Diffusion Forcing trata de unificar na dimensão temporal, então SpatialVLM, outro trabalho do qual participou, trata de complementar capacidades na dimensão espacial.

Este trabalho aborda um problema antigo: embora o modelo possa olhar imagens e falar, ele não entende realmente as relações espaciais. Não conhece a distância, o tamanho ou as posições relativas dos objetos.

Para resolver este problema, sua equipe construiu um sistema de raciocínio espacial tridimensional para que o modelo pudesse não apenas “ver”, mas também “raciocinar”.

Ideias semelhantes também apareceram em outros trabalhos, como o método Guiado pela História, que utiliza informações históricas para orientar a geração, ou pesquisas sobre modelagem unificada de visão, ação e linguagem. Estes esforços podem parecer dispersos, mas todos apontam na mesma direção: fazer com que o modelo não apenas produza resultados, mas forme uma representação estável internamente.

Além de sua direção de pesquisa séria, Chen Boyuan também revela ocasionalmente um interesse pessoal muito vívido.

Por exemplo, desta vez ele publicou um artigo sobre Zhihu e, por exemplo, introduziu especificamente em sua página pessoal que seu interesse é fazer boba, e até mesmo seu nome em Zhihu é "Gerente da loja de chá de leite do MIT".

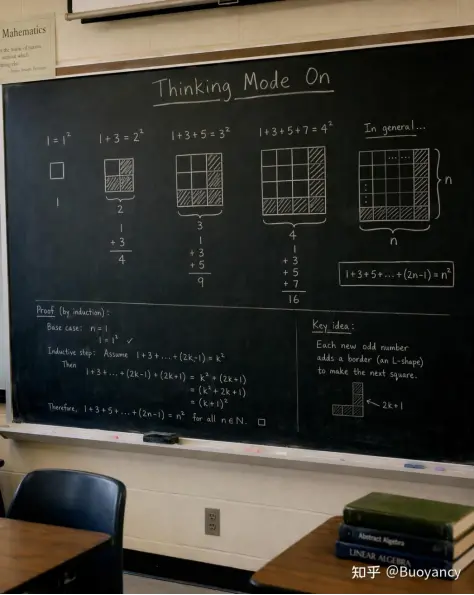

Ele também escreveu um blog para classificar as melhores escolas de ciência da computação nos Estados Unidos. O critério não foi a força da pesquisa científica, mas o chá com leite com bolhas.

Ele classificou Berkeley em primeiro lugar porque o campus é “quase cercado por lojas de chá com leite de alta qualidade”, enquanto o MIT recebeu uma pontuação baixa porque “há poucas lojas de chá com leite nas proximidades e a qualidade é instável”.

Esse tipo de expressão é muito descontraído, mas percebe-se que seus hábitos de pesquisa são: desmontar problemas complexos, encontrar dimensões comparáveis e depois fazer julgamentos.

Seu trabalho em si faz algo semelhante, mas o objeto é substituído por um modelo.

02

Ele evitou a direção mais fácil

Se você olhar apenas para o caminho de desenvolvimento dos modelos de imagem, a lógica do passado é realmente muito clara: dados maiores, resolução mais alta e processo de geração mais estável. A maioria das melhorias concentra-se em “desenhar mais parecido”.

Mas à medida que o modelo passa a processar conteúdos mais complexos, esse caminho também chega a um gargalo: quando a imagem contém não apenas elementos visuais, mas também texto, estrutura e até relações lógicas, a questão não é mais apenas igual ou diferente, mas como essas informações são estabelecidas ao mesmo tempo.

A questão passa da qualidade da produção para a consistência estrutural.

Nem todos os pesquisadores resolverão esse tipo de problema. Não corresponde diretamente a um determinado indicador de avaliação e é difícil traduzi-lo em efeitos de produto no curto prazo. Por outro lado, muitas vezes é mais fácil ver melhorias ao trabalhar na resolução, estilo e detalhes.

O caminho de Chen Boyuan aconteceu para evitar essas direções “mais fáceis”: desde o início de sua pesquisa na fase acadêmica, seu foco não estava nas habilidades monomodais, mas em como diferentes habilidades estão conectadas entre si.

Durante muito tempo, modelos visuais, modelos de linguagem e sistemas de tomada de decisão desenvolveram-se de forma independente. Eles podem ser conectados por meio de interfaces, mas geralmente são separados internamente. Portanto, embora o modelo possa “recorrer às capacidades”, é difícil demonstrar uma compreensão consistente.

O trabalho de Chen Boyuan é tentar mudar esta situação.

Muitas das capacidades do modelo desta vez foram demonstradas na intersecção de “imagens, texto, memes, objetos reais e contexto cultural”.

Chen Boyuan disse que muitas das fotos do blog oficial foram feitas por ele. Todo o blog é gerado a partir de imagens, sem nenhum texto comum. Em outras palavras, muitos dos exemplos que os usuários veem no site oficial não são apenas materiais promocionais, mas parte das próprias capacidades do modelo.

Por exemplo, aquele quadrinho de ovo de páscoa chinês.

Ele queria fazer um desenho animado muito engraçado, então usou "catch stem" e "banana stem". Para demonstrar sua habilidade de escrita, ele pediu especialmente ao modelo para adicionar texto em vários idiomas à imagem e também gerou caracteres chineses muito pequenos no canto inferior direito do pôster da cidade natal para testar quão finos os detalhes o modelo poderia lidar.

Mais importante ainda, essa imagem não é emendada - segundo ele, a imagem inteira, incluindo picture-in-picture e picture-in-picture-in-picture, é gerada de uma só vez. Ele estava preocupado que as pessoas pensassem que era uma imagem emendada, então deliberadamente adicionou uma nota na parte inferior da imagem.

Isso apenas ilustra a dificuldade da imagem GPT 2. Se o modelo de imagem do passado pudesse escrever alguns caracteres grandes sem cometer erros, seria considerado muito bom. Mas a imagem GPT 2 tem que lidar com todo um conjunto de níveis: ele precisa saber que se trata de uma foto de história em quadrinhos, que há fotos na história em quadrinhos e que há fotos nas fotos; precisa colocar texto em diferentes idiomas em diferentes níveis; também precisa estabelecer a relação entre essas palavras e a imagem, em vez de ficarem espalhadas aleatoriamente na imagem.

Outro exemplo é a gravura em grãos de arroz.

Chen Boyuan disse que a princípio sentiu que a renderização de texto comum não era impressionante o suficiente, então ele fez uma imagem em 4K após ser solicitado por seus companheiros de equipe: a imagem mostrava uma pilha de grãos de arroz, um dos quais tinha palavras gravadas.

Isso testa a capacidade do modelo de controlar texto em escalas extremamente pequenas.

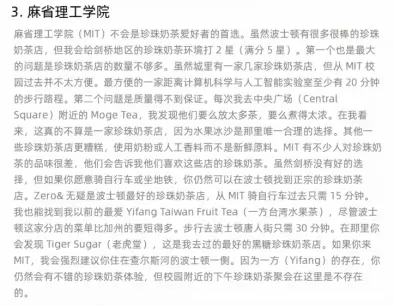

E aquela prova visual no quadro-negro.

Chen Boyuan disse: “Parece muito simples se você pedir a ele para resolver equações matemáticas comuns e coisas do gênero. Nano banana parece ser capaz de fazer isso por meio do modo de pensamento + renderização de texto. Então pensei em uma prova visual que gosto muito para realmente testar a imagem GPT 2. Efeito de raciocínio visual exclusivo. solução, mas a solução gráfica só pode ser feita com o modelo visual”.

Esta também é uma das mudanças mais notáveis no lançamento do GPT Image 2: ele pode começar a transformar um relacionamento abstrato em uma estrutura de imagem e, então, expressar essa estrutura visualmente.

Portanto, ao invés de dizer que a Imagem GPT 2 está “gerando imagens”, é melhor dizer que está gerando uma expressão visual com estrutura.

Quadrinhos, pôsteres, provas visuais... nenhuma dessas coisas são puramente imagens por natureza. Eles também contêm texto, tipografia, hierarquia, relações objetais, objetivos de tarefas e julgamentos estéticos.

Os modelos de imagem anteriores tendem a falhar aqui porque tratam as imagens como resultados de pixels. Esta geração de modelos de imagem mais fortes deve tratar as imagens como uma expressão estruturada.

03

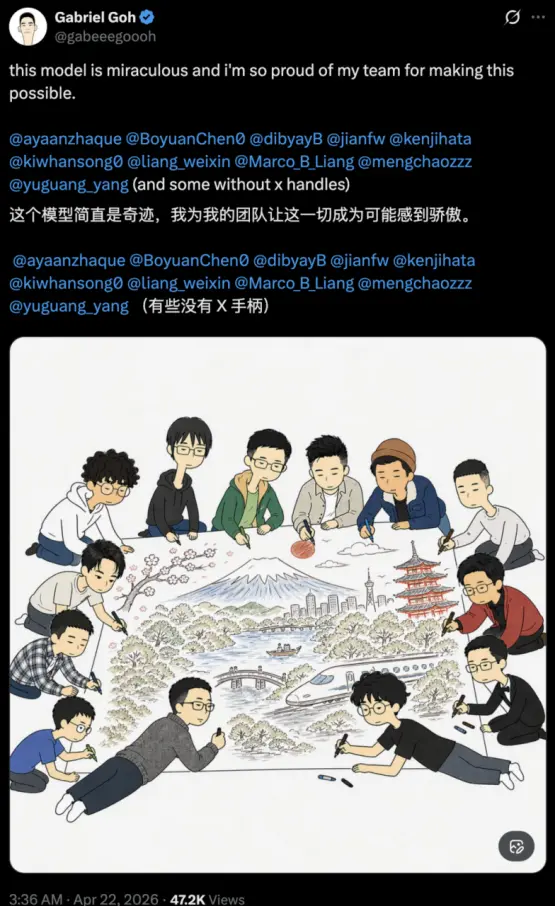

ele não está sozinho

Dentro do OpenAI, não há muitas pessoas realmente envolvidas no treinamento de modelos. Após o lançamento do GPT-image-2, o líder da pesquisa Gabriel Goh agradeceu publicamente aos membros da equipe nas redes sociais.

A lista não é longa, apenas uma dúzia de pessoas.

Isso se parece mais com uma equipe pequena do que com um grande sistema de engenharia.

Os membros da equipe estão espalhados em diferentes direções, alguns cuidam da visão, alguns cuidam dos mecanismos de geração e alguns lidam com a estrutura do sistema, mas, em última análise, apontam para a mesma coisa: dar ao modelo um conjunto de capacidades que podem lidar com imagens, linguagem e estrutura ao mesmo tempo.

A ilustração do tweet também é até certo ponto uma espécie de metáfora: um grupo de pessoas se reúne, cada pessoa é responsável por uma parte e, finalmente, formam a mesma imagem.

A estrutura do modelo, os limites das capacidades e até mesmo "o que a imagem deveria ser" são todos feitos aos poucos nessa equipe.

Uma coisa que vale a pena notar é que entre a equipa principal de mais de uma dúzia de pessoas, podemos ver um número considerável de nomes chineses.

Além de Chen Boyuan, também inclui Jianfeng Wang, que faz modelagem de linguagem visual, Weixin Liang, que faz avaliação de modelos e questões de dados, Yuguang Yang, que está envolvido na geração de imagens há muito tempo, e muitos pesquisadores envolvidos na geração de imagens e treinamento de sistemas.

Chen Boyuan não escreveu este incidente como uma vitória pessoal. Ao final do artigo de Zhihu, ele agradeceu especialmente a toda a equipe. Ele disse que todos fizeram muitas, muitas coisas. No final do período de pré-lançamento, além de consertar algumas pequenas coisas, ele trabalhou com colegas do departamento de marketing e colegas de arte na preparação da coletiva de imprensa e do site.

Ou seja, GPT Image 2 é uma conclusão conjunta de pesquisa, produtos, estética e comunicação. A equipe de modelo precisa criar os recursos, a equipe de arte precisa saber que tipo de imagens podem exibir os recursos e a equipe de marketing precisa traduzir esses recursos em imagens que os usuários comuns possam entender, estar dispostos a testar e a espalhar.

É por isso que muitos dos exemplos nesta versão são especiais. Eles não acabam apenas gerando uma bela imagem, mas criando ativamente problemas: vários idiomas, texto muito pequeno, imagem em imagem, objetos reais, prova visual, pôsteres gerados por pesquisa e incorporação de código QR.

Cada imagem informa ao usuário: o que você achava que o modelo de imagem não poderia fazer antes, você pode tentar novamente agora.

Nesta perspectiva, a posição de Chen Boyuan é muito especial.

Ele está tanto no lado do treinamento de modelos quanto no lado da narrativa editorial; ele não apenas participou da fabricação do modelo, mas também desenhou pessoalmente muitas fotos para permitir que o mundo exterior entendesse as capacidades do modelo.

GPT Image 2 certamente não é trabalho apenas de Chen Boyuan, mas a julgar pelas informações públicas, Chen Boyuan é de fato um dos nomes mais dignos de atenção da comunidade chinesa neste lançamento de modelo de imagem.

Por um lado, o modelo de geração de gráficos GPT lançado desta vez foi seu principal treinamento; por outro lado, ele foi o responsável por uma inovação que é mais facilmente percebida pelos usuários chineses: a renderização chinesa.

Quando a IA finalmente conseguiu escrever chinês em imagens complexas, o pesquisador por trás dela, que há muito estudava modelos mundiais, compreensão espacial e consistência generativa, veio à tona.

“Espero que desta vez tenhamos capturado todos com segurança”, disse ele.